トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

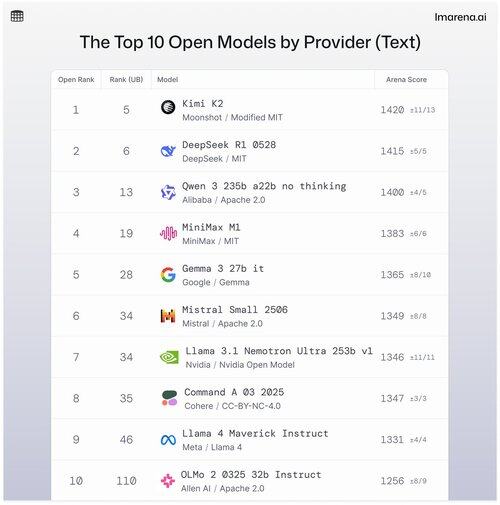

🧵プロバイダー別のオープンモデルトップ10

プロプライエタリモデルがチャートのトップになることがよくありますが、オープンモデルはバトルモードでもペアになり、公開リーダーボードにランクインします。

これは、プロバイダー別のトップオープンモデルごとに積み重ねられた場合のトップ10です。

- #1 キミ K2 (改造 MIT) @Kimi_Moonshot

- #2 ディープシーク R1 0528 (MIT) @deepseek_ai

- #3 Qwen 235b a22b no thinking (Apache 2.0) @alibaba_qwen

- #4 ミニマックス M1 (MIT) @minimax_ai

- #5 ジェマ 3 27b イット (ジェマ) @googledeepmind

- #6 ミストラル スモール ウルトラ (Apache 2.0) @mistral_ai

- #7 ラマ 3.1 ネモトロン ウルトラ 253b v1 (エヌビディア オープン モデル) @nvidia

- #8 コマンドA(コヒア)@cohere

- #9 ラマ 4 マーベリック インストラクト (ラマ 4) @aiatmeta

- #10 OLMo 2 32b Instruct (Apache 2.0) @allen_ai

このリスト👇の上位 5 つについてもう少し詳しく知りたい場合は、スレッドを参照してください

キミK2 - オープンアリーナで#1!

オープンソース モデルに注目しているなら、新進気鋭の AI 企業である Moonshot AI のこの新しいモデルは、これまでで最も印象的なオープンソース LLM の 1 つとして話題を呼んでいます。私たちのコミュニティは、キミ K2 の反応も気に入っていると言っています。キミはロボット的に聞こえすぎず、ユーモラスです。

Kimi K2 は、合計 1 兆のパラメーターを持つ Mixture-of-Experts(MoE)アーキテクチャに基づいて構築されており、そのうち 320 億個が特定の推論中にアクティブです。この設計は、モデルが効率とオンデマンド パフォーマンスのバランスをとるのに役立ちます。

DeepSeekのトップオープンモデルであるDeepSeek R1-0528は#2にランクされています

R1-0528 は、R1 の洗練された命令調整バージョンであり、コミュニティによると #2 の最高のオープン チャット モデルです。マルチターンの対話と推論タスクに優れています。

R1 (ベースライン) はオリジナルで、まだしっかりしていますが、新しいチューニング バリアントにわずかに遅れをとっています。

V3-0324 は、合計 236B のパラメータを持つ MoE モデルですが、プロンプトごとに少数のエキスパートのみをアクティブにします。これにより、強力かつ効率的になります。これは、指示、推論、多言語タスク全体で優れたパフォーマンスを発揮しますが、ここでは R1-0528 よりもプロンプト形式の方が重要です。

Qwen 235b a22b (no thinking) は、アリババのオープンモデルランキングトップで #3 です

235B-a22b-no-thinkingは、命令の調整のない生のモデルです(したがって、「nothinking」)。

生成に優れており、生の推論力によりコミュニティで上位にランクされています。

アリババのコミュニティで参加しているその他のトップオープンモデルには、次のようなものがあります。

32B および 30B-a3b バリアントは、トップクラスのモデルに遅れをとっていますが、安定したパフォーマンスを備えた、より小型で高速な代替品です。32B は 2 つの中で密度が高いため、コミュニティは 30B-a3b よりも精度が高いことを好みます。30B-a3bはMoEモデルなので、少し高速です。

QWQ-32b は、複雑な推論の問題に取り組むために特別に設計されており、DeepSeek R1 などの大規模なモデルのパフォーマンスに匹敵することを目的としていますが、実際のテストに行ったときには、その成果を上げていません。

MiniMax M1 は、トップ モデル ランキングが #4 でリストにランクインしました

M1 は、MoE アーキテクチャと、高効率のトークン処理専用に構築された線形化されたメカニズムである「ライトニング アテンション」と呼ばれるアテンションの形式を組み合わせた独自のアプローチでも際立っています。

このアプローチは、対話、推論、指示に従うのが本当に得意であることで、間違いなく私たちのコミュニティの注目を集めました。

Google DeepMind は、トップのオープン モデルである Gemma 3 27b it で #5 にランクインしました。

Gemma 3 は、オープンウェイトのマルチモーダル言語モデルです。Gemma 3 はテキスト入力と画像入力の両方を処理でき、推論、ロングコンテキスト タスク、ビジョン言語アプリケーションに優れています。私たちのコミュニティは、この Gemma が以前のバージョンよりもメモリ効率を向上させ、より大きなコンテキストのサポートを強化したことを気に入っています。

31.75K

トップ

ランキング

お気に入り