Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Por qué deberías dejar de trabajar en la investigación de RL y en su lugar trabajar en productos //

La tecnología que desbloqueó el gran cambio de escalado en IA es Internet, no transformadores.

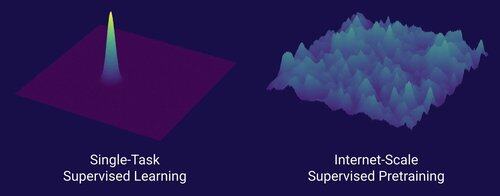

Creo que es bien sabido que los datos son lo más importante en IA, y también que los investigadores eligen no trabajar en ello de todos modos. ... ¿Qué significa trabajar con datos (de una manera escalable)?

Internet proporcionó una rica fuente de datos abundantes, que eran diversos, ofrecían un currículo natural, representaban las competencias que a la gente realmente le importan y era una tecnología económicamente viable para desplegar a gran escala -- se convirtió en el complemento perfecto para la predicción del siguiente token y fue el caldo primordial para que la IA despegara.

Sin transformadores, cualquier número de enfoques podría haber despegado, probablemente podríamos tener CNNs o modelos de espacio de estado al nivel de GPT-4.5. Pero no ha habido una mejora dramática en los modelos base desde GPT-4. Los modelos de razonamiento son geniales en dominios específicos, pero no son un salto tan grande como lo fue GPT-4 en marzo de 2023 (hace más de 2 años...)

Tenemos algo grandioso con el aprendizaje por refuerzo, pero mi profundo temor es que repetiremos los errores del pasado (era de RL 2015-2020) y haremos investigación de RL que no importa.

De la misma manera que Internet fue el dual del preentrenamiento supervisado, ¿cuál será el dual de RL que conducirá a un avance masivo como GPT-1 -> GPT-4? Creo que se parece a la co-diseño de investigación-producto.

389,65K

Parte superior

Clasificación

Favoritos