Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¡Dos nuevos documentos que profundizan en nuestro enfoque de la alineación engañosa!

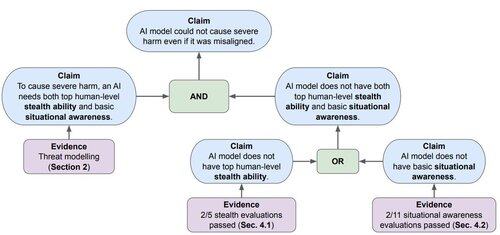

Primer artículo: evaluamos el "sigilo" y la "conciencia situacional" del modelo: si no tienen estas capacidades, es probable que no puedan causar daños graves.

8 jul, 20:02

A medida que avanzan los modelos, una preocupación clave de seguridad de la IA es la alineación engañosa / "intriga", donde la IA podría perseguir de forma encubierta objetivos no deseados. Nuestro artículo "Evaluating Frontier Models for Stealth and Situational Awareness" evalúa si los modelos actuales pueden esquemas.

38.43K

Populares

Ranking

Favoritas