トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

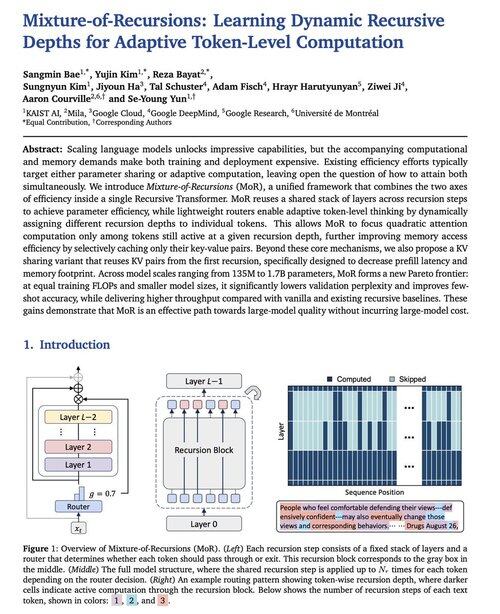

Google DeepMindは、Mixture-of-Recursionsと呼ばれるこの新しいLLMモデルアーキテクチャを廃止しました。

推論速度が 2 倍になり、トレーニング FLOP が削減され、KV キャッシュ メモリが ~50% 削減されます。本当に興味深い読み物です。

トランスフォーマーのキラーになる可能性を秘めています。

源:

237.31K

トップ

ランキング

お気に入り