トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

インターネットには真実の問題があります。

そこで、マルチモデルコンセンサスを使用して幻覚や誤情報を特定するMira Verifyを構築しました。

ミラは真実のマルチシグです。

AIは、幻覚、誤情報、説明責任のゼロなど、インターネット上に氾濫しています。

真実を確認する方法がなければ、社会への悪影響は甚大なものになる可能性があります。

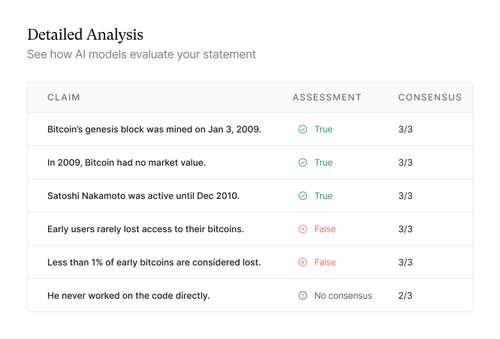

Mira Verifyは、あらゆるコンテンツ(AIであるかどうかにかかわらず)のすべての事実に基づく主張を抽出し、その主張をネットワークにブロードキャストします。

ネットワーク上の各ノードは AI モデルをホストします。その後、各モデルは個別にクレームを検証します。

ネットワークのコンセンサスアルゴリズムは、各モデルからの応答を比較します

全員が同意する場合は、それが真実であり→真実✅としてマークされます

全員が同意する場合は、それは誤り→、誤り❌としてマークされます

意見の相違がある場合。それも問題ありません — 一部の主張はより微妙なニュアンスを含んでおり、ネットワークはこれをプログラムでフラグを立てます。

235.66K

トップ

ランキング

お気に入り