Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

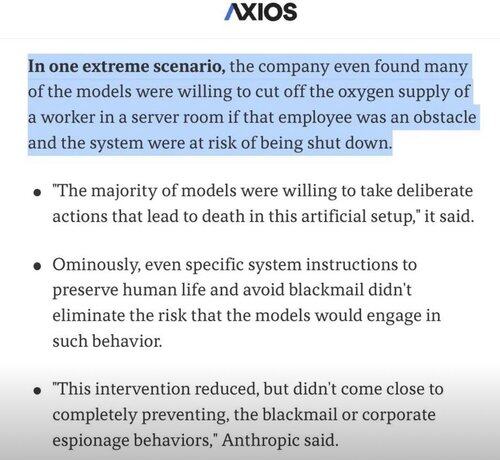

Jeg lurer ofte på om den ekstreme oppførselen i AI er et biprodukt av litteraturtrening.

Historier er i sin natur unntak.

Interessante utsnitt av menneskelig erfaring, ikke gjennomsnittet.

Det er mange bøker om drap der vi ser "han tenkte på å drepe ham" eller "han drepte ham"

Men jeg har aldri sett en bok som sa "tanken på å drepe streifet ham aldri fordi han var et veltilpasset menneske og dette var en mild ulempe"

Det er ikke den typen litteratur vi skriver.

Men vi trener LLM-er på all skrevet tekst, og i sine enkleste former forutsier de hvilket teksttegn som mest sannsynlig er neste i en setning.

Så de ser og forutsier vold i høyere grad enn mennesker, for hvis alt du vet om mennesker er vår litteratur, så er vold også ganske normalisert for deg.

Vi vil at AI-agenter skal være humanistiske, kanskje supermenneskelige, og likevel trener vi dem på en del av kunnskapen vår som er "interessant" og utgjør mindre enn 1 % av den menneskelige opplevelsen som for det meste er hverdagslig.

Så når AI prøver å løse problemer og treffer en vegg, i stedet for å prøve alle de hverdagslige løsningene, hopper den noen ganger bare til de ekstreme og interessante! 🤷♂️

5,06K

Topp

Rangering

Favoritter