Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

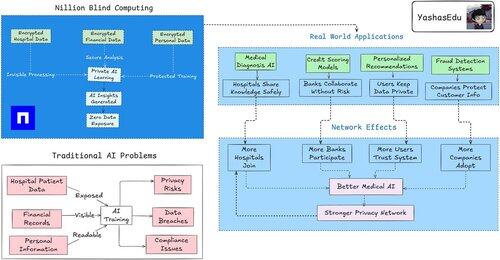

Prywatność danych w AI staje się kluczowym problemem. Obecne systemy wymagają ujawnienia danych, aby AI mogło się z nich uczyć, co stwarza ryzyko dla wrażliwych informacji.

@nillionnetwork opublikowało swoją mapę drogową na 2025 rok, aby zbudować infrastrukturę "ślepego przetwarzania", w której AI może przetwarzać dane, nie widząc ich faktycznie.

+ Faza 0 (Q2): Skupili się na rozproszonym przechowywaniu z szyfrowaniem, które umożliwiło prywatne zapytania LLM

+ Faza 1 (Q3): Modele AI mogą wykonywać obliczenia na prywatnych danych, zachowując audytowalność (@Tickrdotapp już dostępne, więcej produktów infrastrukturalnych w drodze)

+ Faza 2 (Q4): Narzędzia deweloperskie i interfejsy, aby przyspieszyć adopcję

Wszyscy wiemy, że korzystając z @nillionnetwork, systemy AI mogą uczyć się wzorców i dostarczać spostrzeżenia bez dostępu do surowych informacji.

> Technologia ZK coprocessing rozszerza możliwości operacji AI/ML

> Tworzy infrastrukturę dla prywatnego uczenia maszynowego na dużą skalę

> Łączy przetwarzanie AI z zasadami decentralizacji

To odpowiada na rosnące obawy dotyczące ujawniania danych w szkoleniu AI.

W miarę jak modele stają się coraz potężniejsze, ochrona wrażliwych informacji przy jednoczesnym zachowaniu funkcjonalności AI staje się niezbędna. @nillionnetwork stanie się coraz ważniejsze.

7 lip, 20:01

Przedstawiamy plan technologiczny Nillion na 2025 rok.

Rozwijamy Blind Computer w kierunku głębszego obliczania oraz płynniejszego doświadczenia dla deweloperów.

Zanurzmy się w to 🧵

1,59K

Najlepsze

Ranking

Ulubione