Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Por que você deve parar de trabalhar na pesquisa de RL e, em vez disso, trabalhar no produto //

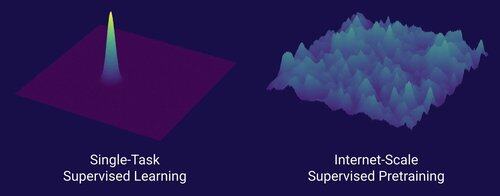

A tecnologia que desbloqueou a grande mudança de escala na IA é a internet, não os transformadores

Acho que é bem sabido que os dados são a coisa mais importante na IA e também que os pesquisadores optam por não trabalhar nisso de qualquer maneira. ... O que significa trabalhar com dados (de forma escalável)?

A internet forneceu uma rica fonte de dados abundantes, que era diversificada, fornecia um currículo natural, representava as competências com as quais as pessoas realmente se importam e era uma tecnologia economicamente viável para implantar em escala – tornou-se o complemento perfeito para a previsão do próximo token e foi a sopa primordial para a IA decolar.

Sem transformadores, qualquer número de abordagens poderia ter decolado, provavelmente poderíamos ter CNNs ou modelos de espaço de estado no nível do GPT-4.5. Mas não houve uma melhoria dramática nos modelos básicos desde o GPT-4. Os modelos de raciocínio são ótimos em domínios estreitos, mas não um salto tão grande quanto o GPT-4 foi em março de 2023 (mais de 2 anos atrás...)

Temos algo ótimo com o aprendizado por reforço, mas meu profundo medo é que repitamos os erros do passado (RL da era 2015-2020) e façamos pesquisas de RL que não importam.

Da mesma forma que a internet era a dupla de pré-treinamento supervisionado, qual será a dupla de RL que levará a um avanço maciço como GPT-1 -> GPT-4? Acho que parece co-design de produto de pesquisa.

389,65K

Melhores

Classificação

Favoritos