Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

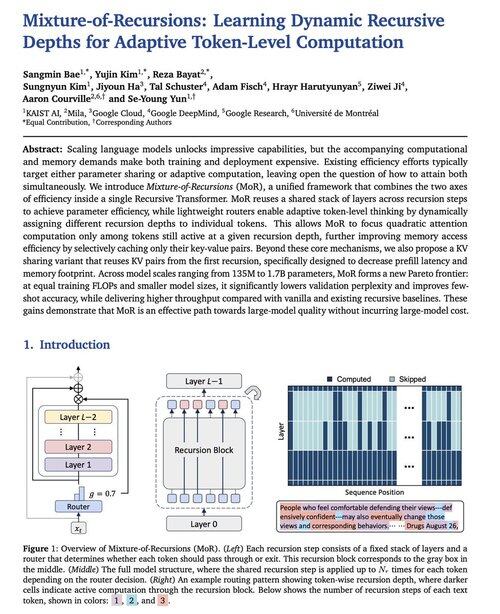

Google DeepMind только что представила новую архитектуру модели LLM под названием Mixture-of-Recursions.

Она обеспечивает в 2 раза большую скорость вывода, сниженные FLOPs при обучении и примерно на 50% меньшую память кэша KV. Действительно интересное чтение.

Имеет потенциал стать убийцей Transformers.

Источник:

237,31K

Топ

Рейтинг

Избранное