Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

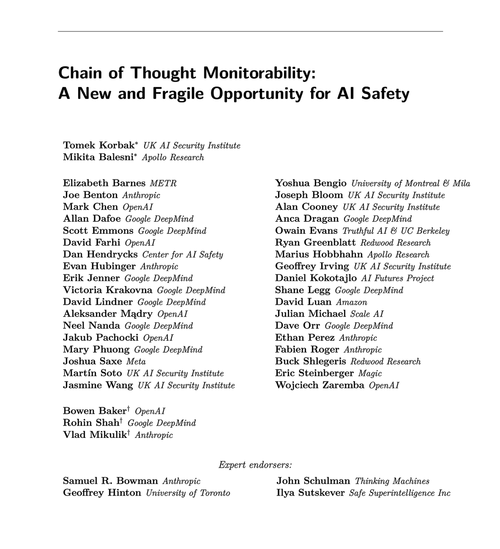

Une technique simple de sécurité pour l'AGI : les pensées de l'IA sont en anglais simple, il suffit de les lire.

Nous savons que cela fonctionne, avec une transparence OK (pas parfaite) !

Le risque est la fragilité : l'entraînement par renforcement, les nouvelles architectures, etc. menacent la transparence.

Des experts de nombreuses organisations s'accordent à dire que nous devrions essayer de la préserver : 🧵

183,63K

Meilleurs

Classement

Favoris