Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Кто-нибудь пробовал использовать RL для переписывания подсказок для моделей рассуждений, чтобы улучшить результаты?

Я предполагаю, что да, это кажется довольно очевидным, но если нет, я хочу попробовать это.

Если вы знаете о какой-либо существующей работе в этой области, пожалуйста, дайте знать, чтобы я не повторял то, что уже сделали другие!

Под этим я имею в виду:

- Взять уже обученную, замороженную модель рассуждений (т.е. o4-mini через API)

- Добавить меньшую LLM, которая принимает запрос и переписывает его, чтобы улучшить работу замороженной модели

- Обновить веса меньшей LLM, оставив большую LLM замороженной

Надеемся, что маленькая LLM научится "направлять" CoT замороженной большой модели лучше, чем это может сделать человек, что повысит производительность.

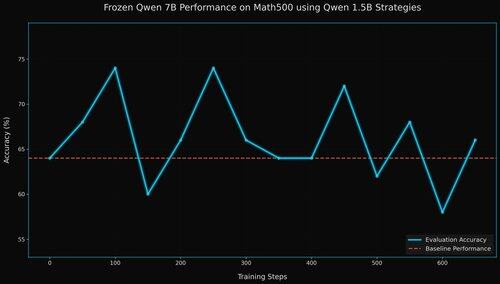

@corbtt напомнил мне об этой работе @brendanh0gan...

Брендан, как все прошло? Похоже, это довольно похоже на то, что я здесь думаю.

3 июл., 08:26

большие модели — отличные агенты, но часто слишком большие, закрытые или хрупкие для тонкой настройки

идея: обучить небольшую модель для создания контекста для замороженной большой модели, оценить выходные данные большой модели, использовать это в качестве вознаграждения для маленькой

группа для настройки контекста. подробнее ниже

8,09K

Топ

Рейтинг

Избранное