热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

在我们最后的博客文章中,我们展示了如何破解隐私保护的 LLM 方案——以近乎完美的准确性解码置换的模型状态。

今天,我们介绍我们的防御措施:Cascade 🕵️♂️✨

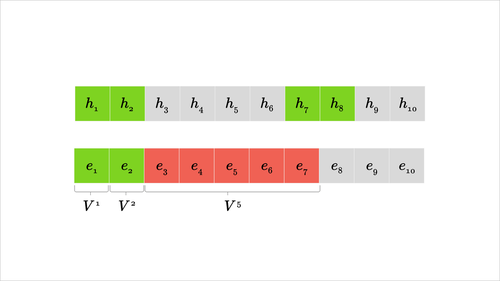

Cascade通过"令牌分片"将隐藏状态分割到各方,从而确保LLM推理的安全性——每个节点仅按顺序查看少量令牌。节点的令牌之间距离越远,攻击的成本就越高——随着距离的增加呈指数增长。

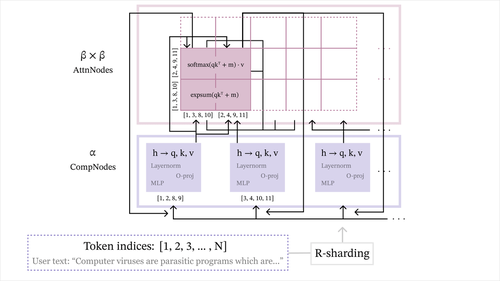

Cascade 在推理中保持完全的保真度——没有近似,没有定点数学。它在 CompNodes(用于 MLP)和 AttnNodes(用于注意力)之间分配计算,确保在分布式阶段之间保留精确结果。

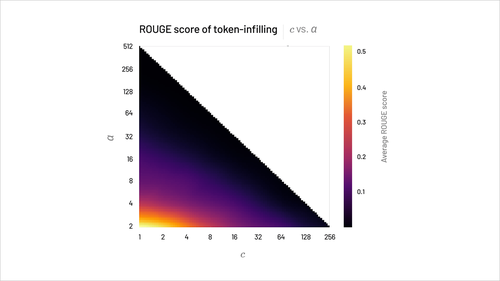

Cascade的核心是一个对我们的重构攻击和已知的基于学习的攻击都具有鲁棒性的代币分片方案。我们在论文中展示了我们的方法,称为c-δ分片,能够在不妥协保真度的情况下实现强隐私。

我们对Cascade在基于学习的攻击下的安全性进行了广泛的实验。虽然它缺乏SMPC的正式保证,但我们证明,只要节点足够多,Cascade在经验上对这些攻击是稳健的。

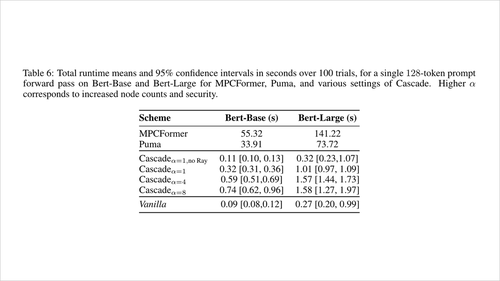

Cascade 最显著的好处是速度和可扩展性。与现有的 SMPC 方案如 MPCFormer 和 Puma 相比,Cascade 快了两个数量级,即使在我们测试的最安全设置(72 个参与者)下也是如此:

Cascade 的动机在于寻找隐私、安全性和可扩展性之间权衡的新范式。我们相信其核心理念——代币分片——达到了这种平衡,并为保护隐私的 LLMs 开辟了新的方向。

我们在攻击和Cascade方面的工作已被ICML 2025接受,将于7月16日下午4:30(太平洋标准时间)在温哥华会议中心东展厅A-B,E-2612室进行展示。

欢迎来和我们聊天!

🔗

来参加我们在ICML的Ritual社交活动吧。与我们的AI和加密研究团队见面,和优秀的人们放松一下,以正确的方式结束你的一天。这是完美的Ritual。

在这里注册:

27.96K

热门

排行

收藏