Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

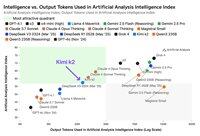

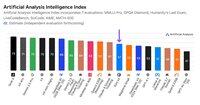

Embora o Kimi k2 da Moonshot AI seja o principal modelo de não raciocínio de pesos abertos no Índice de Inteligência de Análise Artificial, ele produz ~ 3x mais tokens do que outros modelos de não raciocínio, borrando as linhas entre raciocínio e não raciocínio

Kimi k2 é o maior modelo de pesos abertos até agora - parâmetros totais de 1T com 32B ativos (isso requer 1 TB de memória no FP8 nativo para manter os pesos). Temos k2 em 57 no Índice de Inteligência de Análise Artificial, uma pontuação impressionante que o coloca acima de modelos como GPT-4.1 e DeepSeek V3, mas atrás dos principais modelos de raciocínio.

Até agora, havia uma distinção clara entre modelos de raciocínio e modelos não racionais em nossas avaliações - definida não apenas pelo fato de o modelo usar <reasoning> tags, mas principalmente pelo uso de tokens. O número médio de tokens usados para responder a todas as avaliações no Índice de Inteligência de Análise Artificial é ~ 10 vezes maior para modelos de raciocínio do que para modelos sem raciocínio.

O Kimi k2 do @Kimi_Moonshot usa ~ 3x o número de tokens que o modelo mediano de não raciocínio usa. Seu uso de token é apenas até 30% menor do que Claude 4 Sonnet e Opus quando executado em seu modo de pensamento estendido de orçamento máximo, e é quase o triplo do uso de token de Claude 4 Sonnet e Opus com o raciocínio desativado.

Portanto, recomendamos que Kimi k2 seja comparado a Claude 4 Sonnet e Opus em seus modos de pensamento estendido de orçamento máximo, não às pontuações de não raciocínio para os modelos Claude 4.

O Kimi k2 está disponível na API primária do @Kimi_Moonshot, bem como no @FireworksAI_HQ, @togethercompute, @novita_labs e @parasail_io.

Veja abaixo e em Análise Artificial para análise 👇 adicional

60,45K

Melhores

Classificação

Favoritos