Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Jürgen Schmidhuber

Keksi metaoppimisen periaatteet (1987), GAN:t (1990), Transformerit (1991), erittäin syvä oppiminen (1991) jne. Tekoälyämme käytetään useita miljardeja kertoja joka päivä.

Kuka keksi konvoluutiohermoverkot (CNN)?

1969: Fukushimassa oli CNN:n kannalta merkityksellisiä ReLU:ita [2].

1979: Fukushimassa oli CNN:n perusarkkitehtuuri, jossa oli konvoluutiokerroksia ja alasnäytteenottokerroksia [1]. Laskenta oli 100 kertaa kalliimpaa kuin vuonna 1989 ja miljardi kertaa kalliimpaa kuin nykyään.

1987: Waibel sovelsi Linnainmaan vuoden 1970 takaisinetenemistä [3] painonjakoisiin TDNN:iin, joissa on 1-ulotteiset konvoluutiot [4].

1988: Wei Zhang et al. sovelsivat "moderneja" taustalla koulutettuja 2-ulotteisia CNN:iä hahmojen tunnistamiseen [5].

Kaikki edellä mainitut julkaistiin Japanissa vuosina 1979-1988.

1989: LeCun et al. sovelsivat CNN:ää jälleen merkkientunnistukseen (postinumerot) [6,10].

1990-93: Fukushiman spatiaaliseen keskiarvoon perustuva alasnäytteiden otto [1] korvattiin 1-D-TDNN:ien maksimipoolingilla (Yamaguchi et al.) [7] ja 2-D CNN:t (Weng et al.) [8].

2011: Paljon myöhemmin tiimini Dan Ciresanin kanssa teki CNN:ien maksimaalisesta yhdistämisestä todella nopeaa NVIDIA-grafiikkasuorittimilla. Vuonna 2011 DanNet saavutti ensimmäisen yli-inhimillisen hahmontunnistustuloksen [9]. Jonkin aikaa sillä oli monopoli: toukokuusta 2011 syyskuuhun 2012 DanNet voitti jokaisen kuvantunnistushaasteen, johon se osallistui, 4 peräkkäin. Myönnettäköön, että tässä oli kuitenkin enimmäkseen kyse suunnittelusta ja edellisen vuosituhannen perusoivallusten skaalaamisesta, hyötyen paljon nopeammasta laitteistosta.

Jotkut "tekoälyasiantuntijat" väittävät, että "CNN:ien saaminen toimimaan" (esim. [5,6,9]) oli yhtä tärkeää kuin niiden keksiminen. Mutta "niiden saaminen toimimaan" riippui pitkälti siitä, oliko laboratoriosi tarpeeksi rikas ostamaan uusimmat tietokoneet, joita tarvittiin alkuperäisen työn skaalaamiseen. Se on sama kuin nykyään. Perustutkimus vs. suunnittelu/kehitys - T vs. kehitys T&K:ssa.

VIITTAUKSET

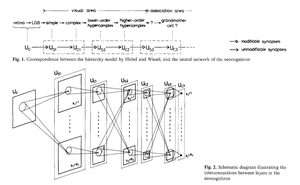

[1] K. Fukushima (1979). Hermoverkkomalli hahmontunnistusmekanismille, johon asennon muutos ei vaikuta - Neocognitron. Käännös IECE, vol. J62-A, nro 10, s. 658-665, 1979.

[2] K. Fukushima (1969). Visuaalinen piirteiden poiminta analogisten kynnyselementtien monikerroksisella verkostolla. IEEE-tapahtumat systeemitieteessä ja kybernetiikassa. 5 (4): 322-333. Tämä työ esitteli tasasuuntaiset lineaariset yksiköt (ReLU), joita käytetään nykyään monissa CNN:issä.

[3] S. Linnainmaa (1970). Pro gradu -tutkielma, Helsingin yliopisto, 1970. Ensimmäinen julkaisu "nykyaikaisesta" takaisinetenemisestä, joka tunnetaan myös automaattisen erottelun käänteisenä tilana. (Katso Schmidhuberin tunnettu takaisinlevityksen yleiskatsaus: "Kuka keksi takaisinetenemisen?")

[4] A. Waibel. Foneemin tunnistus aikaviivehermoverkkojen avulla. IEICE:n kokous, Tokio, Japani, 1987. Taaksepäin eteneminen painon jakavalle TDNN:lle 1-ulotteisilla konvoluutioilla.

[5] W. Zhang, J. Tanida, K. Itoh, Y. Ichioka. Shift-invariantti hahmontunnistushermoverkko ja sen optinen arkkitehtuuri. Japanin soveltavan fysiikan yhdistyksen vuosikonferenssi, 1988. Ensimmäinen takaisinlevityskoulutettu 2-ulotteinen CNN, jossa on sovelluksia englanninkieliseen merkintunnistukseen.

[6] Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, L. D. Jackel: Backpropagation Applied to Handwritten Zip Code Recognition, Neural Computation, 1(4):541-551, 1989. Katso myös [10] 3 §.

[7] K. Yamaguchi, K. Sakamoto, A. Kenji, T. Akabane, Y. Fujimoto. Neuroverkko puhujasta riippumattomaan eristettyyn sanantunnistukseen. Ensimmäinen kansainvälinen puhutun kielen käsittelyä käsittelevä konferenssi (ICSLP 90), Kobe, Japani, marraskuu 1990. 1-ulotteinen konvoluutio-TDNN, joka käyttää Max-Poolingia Fukushiman spatiaalisen keskiarvon sijaan [1].

[8] Weng, J., Ahuja, N. ja Huang, T. S. (1993). 3D-objektien tunnistamisen ja segmentoinnin oppiminen 2D-kuvista. Proc. 4th Intl. Conf. Computer Vision, Berliini, s. 121-128. Kaksiulotteinen CNN, jonka alasampling-kerrokset käyttävät Max-Poolingia (josta on tullut erittäin suosittu) Fukushiman spatiaalisen keskiarvon sijaan [1].

[9] Vuonna 2011 nopea ja syvä GPU-pohjainen CNN nimeltä DanNet (7+ kerrosta) saavutti ensimmäisen yli-inhimillisen suorituksen tietokonenäkökilpailussa. Katso yleiskatsaus: "2011: DanNet käynnistää syvän CNN:n vallankumouksen."

[10] Kuinka 3 Turing-palkittua julkaisi uudelleen keskeisiä menetelmiä ja ideoita, joiden tekijöitä he eivät antaneet kunniaksi. Tekninen raportti IDSIA-23-23, Swiss AI Lab IDSIA, 14. joulukuuta 2023. Katso myös YouTube-video Bower-palkintoseremoniasta 2021: J. Schmidhuber ylistää Kunihiko Fukushimaa.

348,4K

Kuka keksi takaisinlevityksen (BP)? Sen modernin version (kutsutaan myös käänteiseksi automaattiseksi differentiointimoodiksi) julkaisi ensimmäisen kerran vuonna 1970 suomalainen maisteriopiskelija Seppo Linnainmaa. BP:n edeltäjän julkaisi Henry J. Kelley vuonna 1960. Ensimmäisen NN-spesifisen BP:n sovelluksen kuvasi Paul Werbos vuonna 1982 (mutta ei vielä vuoden 1974 väitöskirjassaan, kuten joskus väitetään).

Jotkut kysyvät: "Eikö takaisinlisääntyminen ole vain Leibnizin (1676) ketjusääntö?" Ei, se on tehokas tapa soveltaa ketjusääntöä suuriin verkkoihin, joissa on differentioituvia solmuja. (On myös monia tehottomia tapoja tehdä tämä.) Se julkaistiin vasta vuonna 1970.

Katso lisätietoja takautuvan leviämisen yleiskatsaukselta:

Katso myös "Modernin tekoälyn ja syväoppimisen kommentoitu historia" (2022):

35,22K

Johtavat

Rankkaus

Suosikit