Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Traditionele RAG vs. Graf RAG, duidelijk uitgelegd (met visuals):

top-k retrieval in RAG werkt zelden.

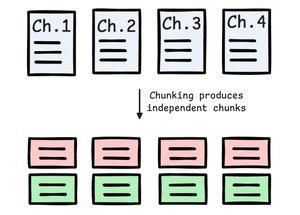

Stel je voor dat je een biografie wilt samenvatten waarin elk hoofdstuk een specifieke prestatie van een individu beschrijft.

Traditionele RAG heeft moeite omdat het alleen top-k stukken ophaalt terwijl het de volledige context nodig heeft.

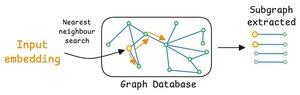

Graph RAG lost dit op door:

- Een grafiek te bouwen met entiteiten en relaties uit documenten.

- De grafiek te doorlopen voor contextretrieval.

- De volledige context naar de LLM te sturen voor een antwoord.

De visual laat zien hoe het verschilt van naïeve RAG:

Laten we eens kijken hoe Graph RAG het bovenstaande probleem oplost.

Eerst zal een systeem (typisch een LLM) een grafiek maken van documenten.

Deze grafiek zal een subgrafiek hebben voor de persoon (P) waarbij elke prestatie één stap verwijderd is van de entiteitsnode van P.

Tijdens de samenvatting kan het systeem een grafdoorloop uitvoeren om alle relevante context met betrekking tot de prestaties van P op te halen.

De volledige context zal de LLM helpen een compleet antwoord te produceren, terwijl naïeve RAG dat niet zal doen.

Graph RAG-systemen zijn ook beter dan naïeve RAG-systemen omdat LLM's van nature goed zijn in redeneren met gestructureerde gegevens.

Ik hoop dat dit verduidelijkt wat Graph RAG is en de problemen die het kan oplossen!

Ik laat je achter met een visuele weergave van hoe het werkt in vergelijking met traditionele RAG.

Als je het inzichtelijk vond, deel het dan opnieuw met je netwerk.

Vind me → @akshay_pachaar ✔️

Voor meer inzichten en tutorials over LLM's, AI Agents en Machine Learning!

29 jul 2025

Traditionele RAG vs. Graf RAG, duidelijk uitgelegd (met visuals):

233,21K

Boven

Positie

Favorieten