Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

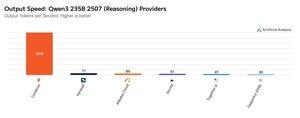

Cerebras heeft deze week zijn vermogen gedemonstreerd om grote MoE's met zeer hoge snelheden te hosten, met de lancering van Qwen3 235B 2507 en Qwen3 Coder 480B eindpunten met >1.500 output tokens/s

➤ @CerebrasSystems biedt nu eindpunten voor zowel Qwen3 235B 2507 Redeneren & Niet-redeneren. Beide modellen hebben 235B totale parameters met 22B actief.

➤ Qwen 3 235B 2507 Redeneren biedt intelligentie vergelijkbaar met o4-mini (hoog) & DeepSeek R1 0528. De Niet-redeneren variant biedt intelligentie vergelijkbaar met Kimi K2 en ver boven GPT-4.1 en Llama 4 Maverick.

➤ Qwen3 Coder 480B heeft 480B totale parameters met 35B actief. Dit model is bijzonder sterk voor agentic coding en kan worden gebruikt in een verscheidenheid aan coding agent tools, waaronder de Qwen3-Coder CLI.

De lanceringen van Cerebras vertegenwoordigen de eerste keer dat dit niveau van intelligentie toegankelijk is geweest bij deze output snelheden en hebben het potentieel om nieuwe gebruikstoepassingen te ontgrendelen - zoals het gebruik van een redeneringsmodel voor elke stap van een agent zonder minuten te hoeven wachten.

25,06K

Boven

Positie

Favorieten