Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

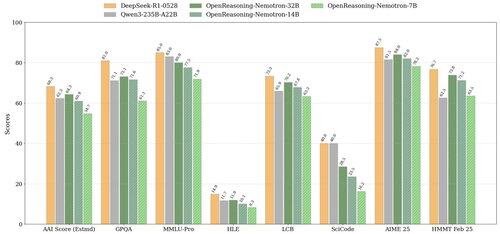

📣 Ogłaszamy wydanie OpenReasoning-Nemotron: zestawu modeli LLM zdolnych do rozumowania, które zostały wyodrębnione z modelu DeepSeek R1 0528 671B. Wytrenowane na ogromnym, wysokiej jakości zbiorze danych wyodrębnionym z nowego DeepSeek R1 0528, nasze nowe modele 7B, 14B i 32B osiągają SOTA wydajność w szerokim zakresie benchmarków rozumowania dla swoich odpowiednich rozmiarów w dziedzinie matematyki, nauki i kodu. Modele są dostępne na @huggingface🤗:

10,3K

Najlepsze

Ranking

Ulubione