Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

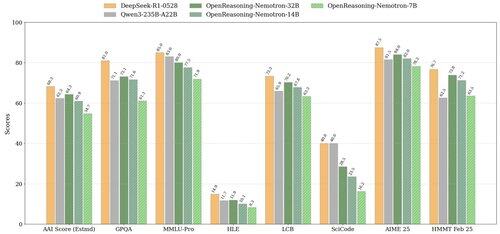

bỏ lỡ điều này, @NVIDIAAIDev đã âm thầm phát hành các mô hình Open Reasoning Nemotron (1.5-32B), SoTA trên LiveCodeBench, được cấp phép CC-BY 4.0 🔥

> 32B cạnh tranh với Qwen3 235B và DeepSeek R1

> Có sẵn ở các kích thước 1.5B, 7B, 14B và 32B

> Hỗ trợ tối đa 64K token đầu ra

> Sử dụng GenSelect (kết hợp nhiều thế hệ song song)

> Xây dựng trên nền tảng của dòng Qwen 2.5

> Cho phép sử dụng thương mại

Hoạt động ngay lập tức trong transformers, vllm, mlx, llama.cpp và nhiều hơn nữa!

24,21K

Hàng đầu

Thứ hạng

Yêu thích