Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Max Ryabinin

Aprendizaje profundo a gran escala e investigación @togethercompute

Learning@home/Autor de Hivemind (DMoE, DeDLOC, SWARM, Petals)

Doctorado en DL descentralizado '2023

Si estás en ICML y estás interesado en la inferencia verificable, ¡asegúrate de pasar por nuestro póster!

Presentaremos TOPLOC, un método eficiente de hash de activación que funciona en una variedad de configuraciones, por ejemplo, configuraciones de inferencia de conmutación o incluso modelos.

16 de julio, 4:30pm, E-1106

1.4K

Desde mi experiencia, conseguir que un documento sobre DL descentralizado sea aceptado en conferencias de alto nivel puede ser bastante difícil. La motivación no es familiar para muchos revisores, y la configuración estándar de los experimentos no tiene en cuenta los problemas que se pretenden resolver.

Por lo tanto, estoy muy emocionado de ver que empresas como @PluralisHQ y @PrimeIntellect invierten el esfuerzo de compartir sus resultados y publicarlos en conferencias importantes. En mi opinión, incluso preparar la presentación te obliga a ser más riguroso con tus experimentos, + los comentarios externos de los revisores te ayudan a afinar el mensaje del artículo.

Alexander Long14 jul, 08:24

Para las personas que no están familiarizadas con la publicación de IA; Hay 3 conferencias principales cada año. ICML, ICLR y NeurIPS. Se trata de conferencias técnicas y el equivalente a las revistas de otras disciplinas: son el principal lugar de publicación de la IA. La competencia para tener trabajos en estas conferencias está ahora en un nivel ridículo, conseguir que los trabajos sean aceptados es muy difícil, y hay mucha preocupación sobre el proceso de revisión, que es bastante ruidoso en este momento. Un artículo sólido y sin defectos tiene alrededor de un 50% de posibilidades de ser aceptado y, por lo general, un artículo se envía con cambios de revisor varias veces hasta que es aceptado. A pesar de todo eso, los artículos en estos lugares siguen siendo el principal sello de legitimidad en el mundo de la IA, y probablemente sigan siendo las principales métricas de carrera para los investigadores de ML (aunque esto se está debilitando, en mi opinión, ya que gran parte de la investigación en los laboratorios de frontera no se publica).

Los documentos de la pista principal son significativamente diferentes a los documentos de taller. La pista principal tiene una revisión por pares intensa y seria. Los documentos de taller son para trabajos preliminares, que dan alguna indicación de un resultado interesante, pero no están completos o el resultado no es lo suficientemente significativo para la pista principal. Solo se requiere que sean revisados por el grupo de revisores del taller y no aparecen en las actas.

Muchos grandes trabajos han aparecido por primera vez en talleres (por ejemplo, grokking), pero los trabajos de taller y de pista principales son cosas fundamentalmente diferentes, con un nivel de impacto fundamentalmente diferente. Las dos únicas empresas de IA descentralizada que tienen un seguimiento principal este año son @PrimeIntellect y Pluralis.

7.24K

Max Ryabinin reposteó

@gowthami_s @JangLawrenceK @IAmTimNguyen @ishapuri101 Formación distribuida en Machine Learning🌍

Únase a nosotros el 12 de julio mientras explora @Ar_Douillard métodos clave como FSDP, Pipeline y Expert Parallelism, además de enfoques emergentes como DiLoCo y SWARM, superando los límites de la capacitación global y distribuida.

Aprende más:

7.27K

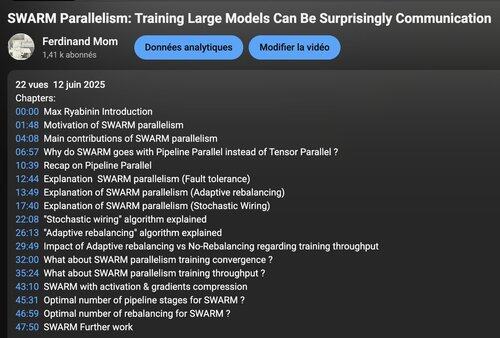

¡Muchas gracias a Ferdinand por organizar esta conversación! Fue una gran oportunidad para ver todas las partes de SWARM y discutir en profundidad la motivación detrás de ellas.

Espero que este video haga que la enseñanza a distancia descentralizada sea más accesible: ¡muchas ideas en el campo son más simples de lo que parecen!

Ferdinand Mom12 jun 2025

La revisión en video del trabajo de investigación sobre "Paralelismo de enjambre" junto con el autor @m_ryabinin, Distinguido Científico Investigador @togethercompute ya está disponible. Enlace a continuación 👇

Para contextualizar, la mayoría de la capacitación descentralizada actual sigue enfoques de estilo DDP que requieren la replicación completa del modelo en cada nodo. Si bien es práctico para aquellos con clústeres H100 a su disposición, esto sigue estando fuera del alcance de la gran mayoría de los contribuyentes potenciales, ¡aquí es donde SWARM resulta útil!

3.1K

Populares

Ranking

Favoritas

Onchain en tendencia

Tendencia en X

Principales fondos recientes

Más destacadas