Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Quelques nouvelles personnelles : Depuis que j'ai quitté OpenAI, j'écris publiquement sur la façon de construire un avenir en IA qui soit réellement passionnant : éviter les pires risques et bâtir un avenir réellement bon.

Je suis ravi de continuer ce travail en tant que membre de l'Institut Roots of Progress.

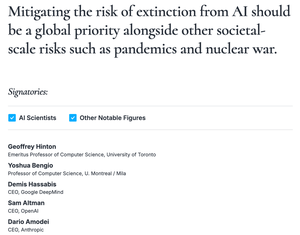

Lorsque j'ai quitté OpenAI, j'ai écrit que j'étais assez terrifié par la direction que prend l'IA. Cela reste vrai, et je connais tant d'employés de laboratoires d'IA qui souhaitent que tout cela s'arrête, mais se sentent individuellement impuissants.

Mais je crois aussi en un avenir profondément positif avec l'IA, si les risques sont bien gérés.

Pour être clair, je pense que les laboratoires d'IA d'aujourd'hui sont complètement à côté de la plaque pour atteindre un avenir positif : ils ne prennent pas les risques de l'IA suffisamment au sérieux, et ils ne font pas de plans qui soient réellement enthousiasmants.

Une façon simple de décrire les risques : les entreprises d'IA se précipitent pour construire une technologie qu'elles ne comprennent absolument pas et qu'elles ne peuvent pas contrôler, mais qu'elles croient pouvoir être extrêmement destructrice.

Et en ce qui concerne les avantages : affirmer que l'IA résoudra le changement climatique ne le rend pas vrai.

Dans mes écrits, j'aspire à vous donner un aperçu honnête et lucide de ce qui se passe dans l'IA, venant de quelqu'un qui travaille dans le domaine depuis près d'une décennie maintenant.

Où les entreprises d'IA jouent-elles avec les mots ? Quels types de réduction des risques sont faciles ? Et de quoi suis-je si préoccupé de toute façon ?

Je suis ravi de rejoindre une communauté d'autres écrivains, mais soyez assuré que je peux toujours dire ce que je veux.

Il y a une pleine indépendance : La seule chose qui devrait changer est, espérons-le, une amélioration de mon style d'écriture.

Si vous souhaitez suivre, vous pouvez vous abonner à Clear-Eyed AI sur ce fameux autre site (cliquez dessus depuis ma bio).

C'est gratuit ; je demande juste que vous partagiez l'information avec d'autres qui pourraient également l'apprécier.

Je ne me suis également jamais correctement présenté là-bas - et donc le post d'aujourd'hui parle de mon histoire d'origine en matière de sécurité de l'IA, et de certaines des idées fondamentales qui guident ma réflexion.

Aussi, une histoire bonus sur la relation surprenante entre la sécurité de l'IA et la "salade de poulet chinoise."

16K

Meilleurs

Classement

Favoris