Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Några personliga nyheter: Sedan jag lämnade OpenAI har jag skrivit offentligt om hur man bygger en AI-framtid som faktiskt är spännande: att undvika de värsta riskerna och bygga en faktiskt bra framtid.

Jag ser fram emot att fortsätta detta arbete som medlem i Roots of Progress Institute.

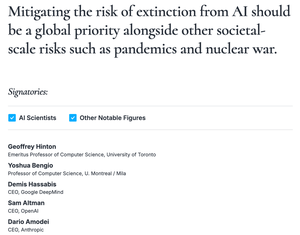

När jag lämnade OpenAI skrev jag att jag är ganska livrädd för vart AI är på väg. Detta är fortfarande sant, och jag vet så många anställda på AI-labbet som vill att allt detta ska upphöra, men som känner sig maktlösa individuellt.

Men jag tror också på en djupt positiv framtid med AI, om risker hanteras på ett bra sätt.

För att vara tydlig, jag tror att AI-laboratorierna idag är långt ifrån rätt för att uppnå en positiv framtid: De tar inte AI:s risker på tillräckligt stort allvar och de gör inte planer som faktiskt är spännande.

Ett enkelt sätt att beskriva riskerna: AI-företag tävlar om att bygga teknik som de absolut inte förstår och inte kan kontrollera, men som de tror kan vara extremt destruktiv.

Och när det gäller fördelar: Att påstå att AI kommer att lösa klimatförändringarna gör det inte så.

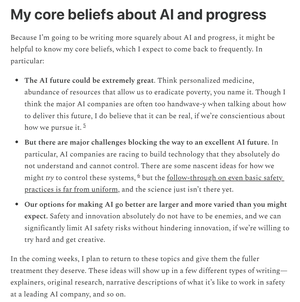

I mitt skrivande strävar jag efter att ge dig en ärlig, klarsynt bild av vad som händer inom AI, från någon som har arbetat inom området i nästan ett decennium nu.

Var spelar AI-företag ordspel? Vilka typer av riskreducering är enkla? Och vad är det jag oroar mig för egentligen?

Jag är glad över att gå med i en gemenskap av andra författare, men var säker på att jag fortfarande kan säga vad jag vill.

Det finns full självständighet: Det enda som borde förändras är, förhoppningsvis, någon förbättring av min skrivstil.

Om du vill följa med kan du prenumerera på Clear-Eyed AI på den ökända andra webbplatsen (klicka på den från min bio).

Det är gratis; Jag ber bara att du delar ordet med andra som kanske också gillar det.

Jag presenterade mig heller aldrig ordentligt där - så dagens inlägg handlar om min historia om AI-säkerhet, ursprung och några av de kärnidéer som driver mitt tänkande.

Dessutom en bonushistoria om det överraskande förhållandet mellan AI-säkerhet och "kinesisk kycklingsallad".

15,96K

Topp

Rankning

Favoriter