トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

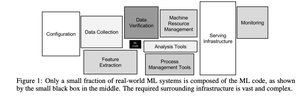

真ん中にある小さな黒いボックスは、機械学習のコードです。

私は、Googleの2015年の「Hidden Technical Debt in ML」という論文を読んで、機械学習アプリケーションが実際の機械学習としてどれほど少ないかを考えたことを覚えています。

その大部分は、インフラストラクチャ、データ管理、運用の複雑さでした。

AIの黎明期には、大規模な言語モデルがこれらのボックスを包含するように思われました。約束はシンプルさでした:LLMをドロップして、カスタマーサービスからコード生成まですべてを処理するのを見てください。複雑なパイプラインや脆弱な統合はもう必要ありません。

しかし、内部アプリケーションの構築では、AIでも同様のダイナミクスが観察されました。

エージェントは、人間のように多くのコンテキストを必要とします:CRMはどのように構成されているか、各フィールドに何を入力するか - しかし、入力は高価です ハングリー、ハングリーAIモデル。

コスト削減とは、AIの推論を置き換える決定論的なソフトウェアを作成することを意味します。

たとえば、メール管理を自動化するということは、Asana のタスクを作成し、CRM を更新するためのツールを作成することを意味します。

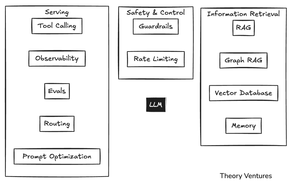

ツールの数が 10 個または 15 個を超えると、ツールの呼び出しは機能しなくなります。従来の機械学習モデルを起動してツールを選択する時が来ました。

次に、可観測性を持ってシステムを監視し、パフォーマンスがあるかどうかを評価し、適切なモデルにルーティングします。さらに、AIが想定どおりに動作することを確認するためのソフトウェアのカテゴリ全体があります。

ガードレールは、不適切な応答を防ぎます。レート制限は、システムがおかしくなったときにコストが制御不能になるのを防ぎます。

情報検索(RAG - retrieval augmented generation)は、あらゆる生産システムに不可欠です。私のメールアプリでは、LanceDBベクターデータベースを使用して、特定の送信者からのすべてのメールを検索し、そのトーンを一致させます。

グラフRAGと特殊なベクターデータベースに関するナレッジマネジメントのための他の手法があります。

最近では、記憶力が格段に重要になってきています。AI ツールのコマンドライン インターフェイスは、会話履歴をマークダウン ファイルとして保存します。

チャートを公開するときは、右下にTheory Venturesのキャプション、特定のフォント、色、スタイルが欲しいです。これらはすべて、一連のカスケードディレクトリの .gemini または .claude ファイル内に保存されるようになりました。

大規模な言語モデルの元々のシンプルさは、エンタープライズグレードの本番環境の複雑さに包含されています。

これは、前世代の機械学習システムと同一ではありませんが、明確な類似点があります。単純な「AIの魔法の箱」のように見えたものは、実際には氷山であり、エンジニアリング作業のほとんどが水面下に隠されています。

3.67K

トップ

ランキング

お気に入り