Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

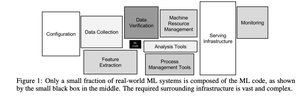

Die kleine zwarte doos in het midden is machine learning code.

Ik herinner me dat ik het paper van Google uit 2015 over Hidden Technical Debt in ML las en dacht hoe weinig van een machine learning toepassing daadwerkelijk machine learning was.

De overgrote meerderheid was infrastructuur, databeheer en operationele complexiteit.

Met de opkomst van AI leek het erop dat grote taalmodellen deze dozen zouden overnemen. De belofte was eenvoud: plaats een LLM en kijk hoe het alles van klantenservice tot codegeneratie afhandelt. Geen complexe pijplijnen of kwetsbare integraties meer.

Maar bij het bouwen van interne applicaties hebben we een vergelijkbare dynamiek met AI waargenomen.

Agenten hebben veel context nodig, zoals een mens: hoe is de CRM gestructureerd, wat vullen we in elk veld in - maar input is duur voor het Hongerige, Hongerige AI-model.

Kosten verlagen betekent deterministische software schrijven om het redeneren van AI te vervangen.

Bijvoorbeeld, het automatiseren van e-mailbeheer betekent tools schrijven om Asana-taken te creëren en de CRM bij te werken.

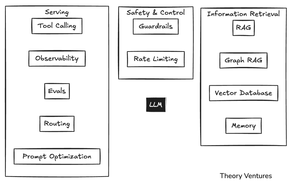

Naarmate het aantal tools boven de tien of vijftien tools uitkomt, werkt het aanroepen van tools niet meer. Tijd om een klassiek machine learning model op te zetten om tools te selecteren.

Dan is er het observeren van het systeem met observability, evalueren of het performant is, en routeren naar het juiste model. Daarnaast is er een hele categorie software die ervoor zorgt dat de AI doet wat het moet doen.

Guardrails voorkomen ongepaste reacties. Rate limiting voorkomt dat kosten uit de hand lopen wanneer een systeem ontspoort.

Informatieophaling (RAG - retrieval augmented generation) is essentieel voor elk productiesysteem. In mijn e-mailapp gebruik ik een LanceDB vector database om alle e-mails van een bepaalde afzender te vinden en hun toon te matchen.

Er zijn andere technieken voor kennisbeheer rond graf RAG en gespecialiseerde vector databases.

Meer recent is geheugen veel belangrijker geworden. De command line interfaces voor AI-tools slaan gespreksgeschiedenis op als markdown-bestanden.

Wanneer ik grafieken publiceer, wil ik dat de Theory Ventures onderschrift rechtsonder staat, een bepaald lettertype, kleuren en stijlen. Die worden nu allemaal opgeslagen binnen .gemini of .claude bestanden in een reeks van cascaderende mappen.

De oorspronkelijke eenvoud van grote taalmodellen is ondergesneeuwd door de complexiteit van enterprise-grade productie.

Dit is niet identiek aan de vorige generatie machine learning systemen, maar het volgt een duidelijke parallel. Wat leek op een eenvoudige "AI-magische doos" blijkt een ijsberg te zijn, met het grootste deel van het engineeringwerk verborgen onder het oppervlak.

3,65K

Boven

Positie

Favorieten