Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Economia AI atinge un punct critic de inflexiune. Potrivit cercetărilor, costurile de antrenament pentru modelele AI de frontieră sunt proiectate să ajungă la peste 1 miliard de dolari până în 2027.

CEO-ul @AnthropicAI, Dario Amodei, a prezis că anul viitor, costurile de antrenament pentru modelele AI vor crește la câteva miliarde de dolari pe rulare.

"În 2026, ar putea fi peste 10 miliarde de dolari pentru a antrena un singur model. Până în 2027, el anticipează că companiile model vor avea ambiția de a construi clustere de formare de 100 de miliarde de dolari."

Bariera hardware este uluitoare: a costat aproximativ 800 de milioane de dolari doar pentru a achiziționa hardware-ul folosit pentru a antrena GPT-4, comparativ cu 40 de milioane de dolari pentru costurile amortizate.

Cu costurile de formare în creștere cu ~2,4× pe an, infrastructura de calcul ineficientă devine o amenințare existențială pentru companiile AI care nu își pot optimiza cheltuielile.

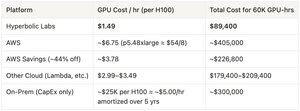

Să analizăm costurile reale: Antrenarea unui LLM cu parametri 7B pe 1-2 trilioane de jetoane necesită ~60.000 H100 de ore GPU. La tariful nostru (1,49 USD/oră), asta înseamnă 89.400 USD în total.

Același volum de lucru pe AWS la cerere?

Un uimitor 405.000 de dolari. Alți furnizori de cloud variază între 179,400 USD și 209,400 USD, în timp ce soluțiile on-premise costă aproximativ 300,000 USD atunci când sunt amortizate complet.

Platforma noastră oferă un avantaj clar: cu 2,5× mai ieftin decât AWS cu reducere și cu 3-4× mai ieftin decât furnizorii tipici de cloud. Infrastructura locală costă cu 6-9× mai mult atunci când se contabilizează toate cheltuielile. Pentru echipele care doresc o scalare transparentă și prietenoasă cu bugetul de formare LLM, oferta noastră oferă economii imediate și simplitate operațională.

Pe măsură ce modelele continuă să crească, eficiența de calcul nu este doar un lucru plăcut, ci este șanțul tău competitiv. Întrebarea nu este dacă vă puteți permite să optimizați, ci dacă vă puteți permite să nu o faceți. Începeți să vă maximizați bugetul AI astăzi la .

Referinţe

Epoca AI. "Tendințe în preț-performanță GPU." Epoca AI, 2022, .

Hobbhahn, Marius și Tamay Besiroglu. "Tendințe în preț-performanță GPU." Epoca AI, 2022, .

Centre de date TRG. "Deblocarea economiilor: de ce GPU-urile NVIDIA H100 depășesc costurile de închiriere AWS." Centre de date TRG, 2023,

Cottier, Ben, et al. "Costurile în creștere ale antrenamentului modelelor AI de frontieră." arXiv, 2024,

Consultați blogul complet aici:

1,65K

Limită superioară

Clasament

Favorite