トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

AI の経済性は重大な転換点に達しています。調査によると、フロンティアAIモデルのトレーニングコストは2027年までに10億ドル以上に達すると予測されています。

@AnthropicAIのダリオ・アモデイ最高経営責任者(CEO)は、来年、AIモデルのトレーニングコストは1回あたり数十億ドルに増加すると予測した。

「2026年には、1つのモデルをトレーニングするのに100億ドルを超える可能性があります。2027年までに、モデル企業は1,000億ドルのトレーニングクラスターを構築するという野心を持つようになると予想しています。」

ハードウェアの障壁は驚異的で、GPT-4 のトレーニングに使用されるハードウェアを取得するだけでも約 $800M の費用がかかりますが、償却コストは $40M でした。

トレーニングコストが年間~2.4×で増加する中、非効率的なコンピューティングインフラストラクチャは、支出を最適化できないAI企業にとって存続の脅威になりつつあります。

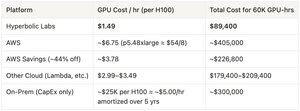

実際のコストを分析してみましょう:1〜2兆トークンで7BパラメータLLMをトレーニングするには、~60,000 H100 GPU時間が必要です。私たちの料金 (1.49 ドル/時間) では、合計 89,400 ドルになります。

AWS で同じワークロードをオンデマンドで使用しますか?

405,000ドルという驚異的な金額です。他のクラウドプロバイダーは179,400ドルから209,400ドルの範囲ですが、オンプレミスソリューションは全額償却した場合に約300,000ドルかかります。

当社のプラットフォームには、割引されたAWSよりも2.5×安く、一般的なクラウドプロバイダーよりも3〜4×安いという明確な利点があります。オンプレミスのインフラストラクチャは、すべての費用を考慮すると6〜9×コストが高くなります。主要なLLMトレーニングを予算にやさしく、透過的に拡張することを目指すチームにとって、当社のサービスは即時の節約と運用の簡素化を実現します。

モデルが成長し続けるにつれて、コンピューティング効率は単にあれば良いだけでなく、競争の堀でもあります。問題は、最適化する余裕があるかどうかではなく、最適化しない余裕があるかどうかです。今すぐ AI 予算の最大化を始めましょう。

参照

エポックAI。「GPUの価格性能の動向」。エポックAI、2022年、。

ホブハーン、マリウス、タメイ・ベシログル。「GPUの価格性能の動向」。エポックAI、2022年、。

TRG データセンター。「節約の解き放つ: NVIDIA H100 GPU が AWS のレンタルコストを上回る理由」TRG データセンター、2023 年、

Cottier, Ben, et al. 「フロンティア AI モデルのトレーニングのコストの上昇」 arXiv、2024 年、

ブログ全文はこちらからご覧ください。

1.65K

トップ

ランキング

お気に入り