Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

La economía de la IA está alcanzando un punto de inflexión crítico. Según investigaciones, se proyecta que los costos de entrenamiento para modelos de IA de vanguardia superen los 1.000 millones de dólares para 2027.

El CEO de @AnthropicAI, Dario Amodei, predijo que el próximo año, los costos de entrenamiento para modelos de IA crecerán a varios miles de millones de dólares por ejecución.

"En 2026, puede que supere los 10.000 millones de dólares entrenar un solo modelo. Para 2027, anticipa que las empresas de modelos tendrán ambiciones de construir clústeres de entrenamiento de 100.000 millones de dólares."

La barrera de hardware es asombrosa: costó aproximadamente 800 millones de dólares solo adquirir el hardware utilizado para entrenar GPT-4, en comparación con 40 millones de dólares por los costos amortizados.

Con los costos de entrenamiento creciendo a ~2.4× por año, la infraestructura de computación ineficiente se está convirtiendo en una amenaza existencial para las empresas de IA que no pueden optimizar sus gastos.

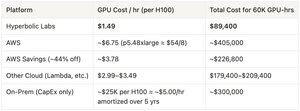

Desglosemos los costos reales: Entrenar un LLM de 7B parámetros en 1-2 billones de tokens requiere aproximadamente 60,000 horas de GPU H100. A nuestra tarifa (1,49 $/hora), eso suma un total de 89,400 $.

¿La misma carga de trabajo en AWS bajo demanda?

Un asombroso 405,000 $. Otros proveedores de la nube oscilan entre 179,400 $ y 209,400 $, mientras que las soluciones locales cuestan alrededor de 300,000 $ cuando están completamente amortizadas.

Nuestra plataforma ofrece una clara ventaja: 2.5× más barata que AWS con descuento y 3-4× más barata que los proveedores de nube típicos. La infraestructura local cuesta 6-9× más al tener en cuenta todos los gastos. Para los equipos que buscan una escalabilidad económica y transparente en el entrenamiento de grandes LLM, nuestra oferta proporciona ahorros inmediatos y simplicidad operativa.

A medida que los modelos continúan creciendo, la eficiencia computacional no es solo un lujo, es tu ventaja competitiva. La pregunta no es si puedes permitirte optimizar, sino si puedes permitirte no hacerlo. Comienza a maximizar tu presupuesto de IA hoy en .

Referencias

Epoch AI. "Tendencias en el rendimiento-precio de GPU." Epoch AI, 2022, .

Hobbhahn, Marius, y Tamay Besiroglu. "Tendencias en el rendimiento-precio de GPU." Epoch AI, 2022, .

TRG Datacenters. "Desbloqueando ahorros: por qué las GPU NVIDIA H100 superan los costos de alquiler de AWS." TRG Datacenters, 2023,

Cottier, Ben, et al. "El aumento de los costos de entrenamiento de modelos de IA de frontera." arXiv, 2024,

Consulta el blog completo aquí:

1,64K

Parte superior

Clasificación

Favoritos