Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Kinh tế của AI đang đạt đến một điểm chuyển tiếp quan trọng. Theo nghiên cứu, chi phí đào tạo cho các mô hình AI tiên tiến dự kiến sẽ vượt quá 1 tỷ đô la vào năm 2027.

Giám đốc điều hành của @AnthropicAI, Dario Amodei, dự đoán rằng vào năm tới, chi phí đào tạo cho các mô hình AI sẽ tăng lên vài tỷ đô la cho mỗi lần chạy.

"Vào năm 2026, có thể sẽ trên 10 tỷ đô la để đào tạo một mô hình duy nhất. Đến năm 2027, ông dự đoán rằng các công ty mô hình sẽ có tham vọng xây dựng các cụm đào tạo trị giá 100 tỷ đô la."

Rào cản phần cứng thật đáng kinh ngạc: Chi phí khoảng 800 triệu USD chỉ để mua phần cứng dùng để đào tạo GPT-4, so với 40 triệu USD cho chi phí khấu hao.

Với chi phí đào tạo tăng trưởng khoảng 2,4 lần mỗi năm, cơ sở hạ tầng tính toán không hiệu quả đang trở thành một mối đe dọa tồn vong cho các công ty AI không thể tối ưu hóa chi tiêu của họ.

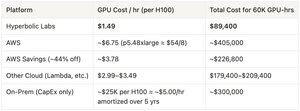

Hãy phân tích chi phí thực tế: Để đào tạo một mô hình LLM 7B tham số trên 1-2 triệu token cần khoảng 60.000 giờ GPU H100. Với mức giá của chúng tôi (1,49 USD/giờ), tổng chi phí là 89.400 USD.

Cùng khối lượng công việc đó trên AWS theo yêu cầu?

Một con số đáng kinh ngạc là 405.000 USD. Các nhà cung cấp đám mây khác dao động từ 179.400 USD đến 209.400 USD, trong khi các giải pháp tại chỗ có chi phí khoảng 300.000 USD khi được khấu hao hoàn toàn.

Nền tảng của chúng tôi mang lại một lợi thế rõ ràng: rẻ hơn 2.5 lần so với AWS đã giảm giá và rẻ hơn 3-4 lần so với các nhà cung cấp đám mây thông thường. Chi phí hạ tầng tại chỗ cao hơn 6-9 lần khi tính đến tất cả các chi phí. Đối với các đội ngũ hướng tới việc mở rộng ngân sách một cách thân thiện và minh bạch cho việc đào tạo LLM lớn, sản phẩm của chúng tôi mang lại tiết kiệm ngay lập tức và sự đơn giản trong vận hành.

Khi các mô hình tiếp tục phát triển, hiệu quả tính toán không chỉ là một điều tốt để có - nó là lợi thế cạnh tranh của bạn. Câu hỏi không phải là liệu bạn có thể đủ khả năng để tối ưu hóa hay không, mà là liệu bạn có thể đủ khả năng không tối ưu hóa hay không. Hãy bắt đầu tối đa hóa ngân sách AI của bạn ngay hôm nay tại .

Tài liệu tham khảo

Epoch AI. "Xu hướng về giá và hiệu suất GPU." Epoch AI, 2022, .

Hobbhahn, Marius, và Tamay Besiroglu. "Xu hướng về giá và hiệu suất GPU." Epoch AI, 2022, .

TRG Datacenters. "Mở khóa tiết kiệm: Tại sao GPU NVIDIA H100 lại vượt trội hơn chi phí thuê AWS." TRG Datacenters, 2023,

Cottier, Ben, và các cộng sự. "Chi phí ngày càng tăng của việc đào tạo các mô hình AI tiên tiến." arXiv, 2024,

Xem toàn bộ blog tại đây:

1,64K

Hàng đầu

Thứ hạng

Yêu thích