熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

AI的經濟學正達到一個關鍵的轉折點。根據研究,前沿AI模型的訓練成本預計到2027年將超過10億美元。

@AnthropicAI的CEO Dario Amodei預測,明年AI模型的訓練成本將增長到每次運行幾十億美元。

"到2026年,訓練單一模型的成本可能會超過100億美元。到2027年,他預計模型公司將有建設1000億美元訓練集群的雄心。"

硬體障礙令人震驚:僅僅獲得用於訓練 GPT-4 的硬體就花費了約 8 億美元,而攤銷成本僅為 4000 萬美元。

隨著訓練成本每年增長約 2.4 倍,無效率的計算基礎設施正成為無法優化支出的 AI 公司的生存威脅。

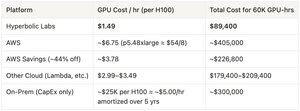

讓我們來分析一下實際成本:在1-2萬億個標記上訓練一個7B參數的LLM需要約60,000小時的H100 GPU。按照我們的費率($1.49/小時),總共是$89,400。

在AWS按需的同樣工作量呢?

驚人的$405,000。其他雲服務提供商的價格範圍在$179,400-$209,400之間,而本地解決方案在完全攤銷後的成本約為$300,000。

我們的平台提供明顯的優勢:比折扣後的 AWS 便宜 2.5 倍,比典型的雲端服務提供商便宜 3-4 倍。考慮到所有費用,內部基礎設施的成本高出 6-9 倍。對於希望以預算友好、透明的方式擴展大型 LLM 訓練的團隊,我們的產品提供了即時的節省和操作簡便性。

隨著模型不斷增長,計算效率不僅僅是一個可有可無的選項——它是你的競爭護城河。問題不在於你是否能夠優化,而在於你是否能夠不優化。今天就開始最大化你的 AI 預算吧。

參考文獻

Epoch AI. "GPU 價格-性能趨勢." Epoch AI, 2022, .

Hobbhahn, Marius, 和 Tamay Besiroglu. "GPU 價格-性能趨勢." Epoch AI, 2022, .

TRG Datacenters. "解鎖節省:為什麼 NVIDIA H100 GPU 優於 AWS 租賃成本." TRG Datacenters, 2023,

Cottier, Ben 等. "訓練前沿 AI 模型的上升成本." arXiv, 2024,

查看完整的部落格文章在這裡:

1.63K

熱門

排行

收藏