Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Teknium (e/λ)

Teknium (e/λ) ha ripubblicato

🚀 MegaTTS 3 il cloning vocale è qui

Per contesto: un po' di tempo fa, ByteDance ha rilasciato MegaTTS 3 (con eccezionali capacità di cloning vocale), ma per vari motivi, hanno deciso di non rilasciare l'encoder WavVAE necessario per il funzionamento del cloning vocale.

Recentemente, un encoder WavVAE compatibile con MegaTTS 3 è stato rilasciato da ACoderPassBy su ModelScope con risultati piuttosto promettenti.

Nel complesso sembra piuttosto impressionante - sono entusiasta di vedere che finalmente possiamo fare cloning vocale con MegaTTS 3!

(h/t a MysteryShack su Discord di StyleTTS 2 per le informazioni sull'encoder WavVAE)

1,15K

Non ci sono stati studi sui ragionatori ibridi? Sto per eseguire alcuni test su un nuovo modello senza un dataset non di ragionamento.

Ti farò sapere come i dati solo di ragionamento influenzano il modello rispetto a quando ci sono dati privi di ragionamento. Probabilmente tra qualche settimana avrò alcune buone intuizioni se riesco a trovare il tempo.

4,7K

Ricordo quando tutti dicevano che era un problema di tokenizer.

Flavio Adamo19 lug, 22:01

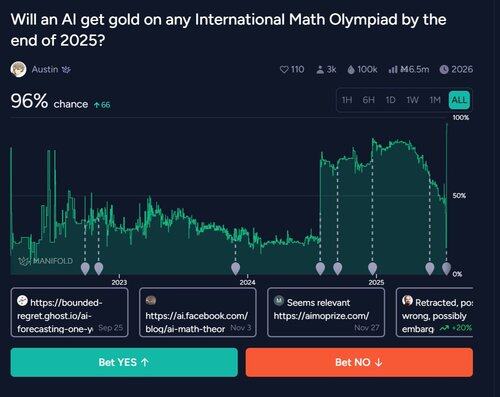

2020: "I LLM non possono fare matematica."

2025: L'LLM vince l'oro all'IMO

33,9K

Teknium (e/λ) ha ripubblicato

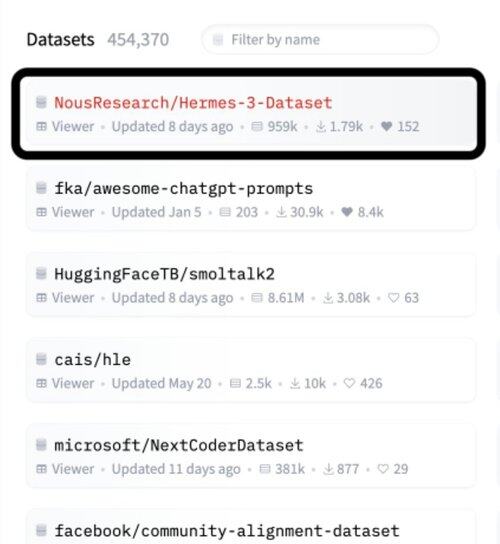

Hermes 3 di @NousResearch è il dataset #1 su @huggingface

Ho intenzione di usarlo

Non dormire su Nous

Loro:

- Creano fantastici fine-tune open source

- Hanno costruito un calcolo distribuito

- Hanno dataset ben curati

- Sono completamente trasparenti con i pesi e il codice del modello

- Pubblicano opinioni basate su X

6,89K

La mia migliore ipotesi:

Rubriche + Giudice LLM - Atomizzare ogni punto nella prova di verità e controllare rispetto all'output del modello.

La mia ipotesi su come l'hanno resa scalabile - poiché prima non lo era, gli esseri umani dovevano crearle meticolosamente, è che hanno addestrato o fatto qualcosa per generare rubriche molto buone per ogni problema specifico o la sua risposta.

22,03K

Prima di iniziare, creiamo un'IDE di codifica per l'IA in modo da poter ottenere solo dati di qualità.

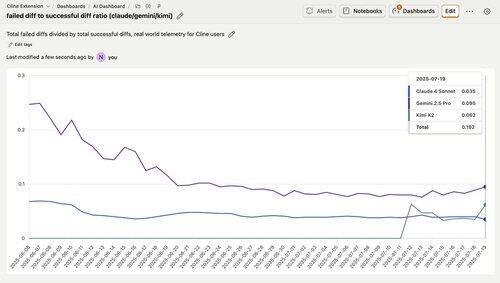

pash19 lug, 09:58

Vorrei sottolineare che per i compiti del mondo reale (non benchmark), Kimi K2 supera Gemini.

Questa è la telemetria di tutti gli utenti @cline, che mostra il tasso di errore nelle modifiche. Nota come Kimi abbia circa un tasso di errore del 6%, che è significativamente migliore rispetto al tasso di errore di circa il 10% di Gemini.

Incredibilmente, Kimi ha persino superato Claude 4 per la maggior parte di questa settimana, raggiungendo un tasso di errore inferiore al 4%!

6,79K

Principali

Ranking

Preferiti

On-chain di tendenza

Di tendenza su X

Principali fondi recenti

Più popolari