المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

أنا أتفق بشدة:1. التعاون الموازي بين وكلاء متعددين ليس مستقرا مثل مؤشر ترابط واحد. 2. RAG ليست موثوقة مثل البحث التقليدي. 3. كلما زاد عدد التعليمات في الموجه ، زاد عدم معرفة النموذج بكيفية الاختيار.

—— الترجمة الأصلية هي كما يلي ——

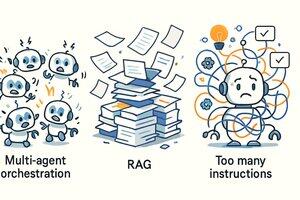

في الطريق إلى بناء وكلاء الذكاء الاصطناعي ، حدد فريقنا @Cline ثلاثة "فيروسات تفكير". ما يسمى ب "فيروس التفكير" هو تلك الأفكار المغرية التي تبدو ذكية للغاية ولكنها لا تعمل على الإطلاق في الممارسة العملية.

الفيروسات الثلاثة هي:

* تنسيق متعدد العوامل

* الاسترجاع الجيل المعزز (RAG)

* كلما زاد عدد التعليمات = كان التأثير أفضل

هيا نكتشف!

1. التعاون متعدد الوكلاء

هذا النوع من المشهد في فيلم خيال علمي - "العملاء الخلفيون ، وكلاء الذخيرة ، وكلاء التحليل ، عملاء القيادة" - إرسال مجموعة كبيرة من العملاء الفرعيين ، وأخيرا تلخيص النتائج - يبدو رائعا حقا. لكن الحقيقة هي أن الغالبية العظمى من عمل الوكيل المفيد هو خيط واحد.

نادرا ما تقدم عمليات التعاون المعقدة قيمة حقيقية وغالبا ما تخلق الفوضى. كما تعلم ، من الصعب بما فيه الكفاية جعل النموذج يعمل بثبات في خيط واحد ، ناهيك عن التعامل مع منطق التعاون الموازي. هذا لا يزيد من تعقيد التنفيذ فحسب ، بل يجعل أيضا عملية فهم النموذج واتخاذ القرار معقدا للغاية.

2. استخدام RAG لبناء الوكلاء

RAG ، أو الجيل المعزز للاسترجاع ، هو أيضا فيروس فكري. يبدو قويا من الناحية النظرية ، ولكن من الناحية العملية ، خاصة في سيناريوهات الوكيل ، حتى أوامر البحث عن النص الأساسية مثل GREP تكون أحيانا أفضل منه.

لماذا تتلاشى هالة RAG في سير عمل الوكيل الفعلي؟ لأن المعلومات المسترجعة غالبا ما تكون مجزأة ولا يمكن أن تسمح للنموذج بتكوين "فهم" متماسك ومفيد.

يتمثل النهج الأفضل دائما في السماح للنموذج بإدراج الملفات من تلقاء نفسه ، والبحث بطريقة تشبه grep ، ثم فتح الملف بأكمله وقراءته (تماما مثل الإنسان). بدأ فريق @Cline في القيام بذلك مبكرا ، ثم رأينا أن @Amp - معاينة البحث و @Cursor - انتقل أيضا إلى هذا النهج الأكثر واقعية.

3. المزيد من التعليمات = كلما كان التأثير أفضل

هناك اعتقاد خاطئ واسع الانتشار بأن تراكم المزيد والمزيد من "التعليمات" في مطالبات النظام يجعل النموذج أكثر ذكاء. هذا خطأ تماما.

سيؤدي "سقي" المطالبة إلى إرباك النموذج فقط ، حيث تميل المزيد من التعليمات إلى الاقتراحات المتضاربة والحمل الزائد للمعلومات.

نتيجة لذلك ، عليك أن تلعب لعبة "ضرب الخلد" والعبث باستمرار بكل أنواع السلوكيات الغريبة للنموذج بدلا من الحصول على مخرجات مفيدة حقا. بالنسبة لمعظم النماذج المتطورة اليوم ، فإن أفضل طريقة للابتعاد عن طريقهم هي عدم الصراخ عليهم في محاولة لتوجيههم في اتجاه معين. يرجى الاعتزاز بكل كلمة (أو رمز) لديك.

بشكل عام ، جميع الأفكار الثلاث المذكورة أعلاه مغرية للغاية. إذا كنت لا تعمل مع الذكاء الاصطناعي طوال اليوم ، فقد تعتقد أنها جميعا منطقية للغاية - لكنها لا تفعل ذلك. بالطبع ، مع تحسن قدرات النماذج الأساسية ، قد يتغير تصورنا لهذه الأساليب في المستقبل.

20 أغسطس، 01:00

في بناء وكلاء الذكاء الاصطناعي @cline ، حددنا ثلاثة فيروسات عقلية فيروسات العقل هي أفكار مغرية تبدو ذكية ، ولكنها لا تعمل في الممارسة العملية.

1. تنسيق متعدد الوكلاء

2. RAG (الجيل المعزز للاسترجاع)

3. المزيد من التعليمات = نتائج أفضل

دعنا نستكشف لماذا!

85.86K

الأفضل

المُتصدِّرة

التطبيقات المفضلة