Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

“Escucha, él sigue hablando sin parar, pero esta vez, finalmente podemos confirmar lo que dijo.”

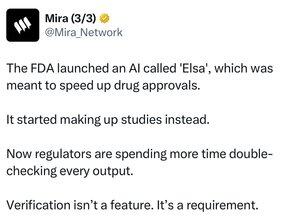

Mira @Mira_Network tal vez nunca pensó en hacer que la IA se parezca más a un humano, solo quería que cada vez que la IA hablara, pudiera dejar evidencia verificable.

Hacer que la "caja negra" más poderosa de esta era se convierta en la existencia más transparente en la cadena.

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

Mira @Mira_Network : poner frenos a la IA que avanza a alta velocidad, en lugar de añadirle alas.

La IA puede hablar, puede escribir código, puede simular emociones, pero ¿realmente se puede confiar en ella? Esa es la cuestión que Mira @Mira_Network viene a resolver.

La respuesta de Mira es clara: no se trata de cuán humano se parezca, sino de si puede dejar un "he dicho esto" que valga la pena que cada persona lo analice.

Esta es precisamente la mayor divergencia entre Mira @Mira_Network y la gran mayoría de los proyectos de IA; no persigue demostrar cuán "inteligente" es, sino que va en contra de eso, decidiendo construir una base "confiable".

No confía en la apariencia de ningún modelo, sino que en la arquitectura subyacente, para cada acción de la IA, cada respuesta, cada juicio, incrusta una trayectoria verificable.

Esto no es optimizar la experiencia, sino definir la "respuesta".

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

La IA siempre es una herramienta, no un sujeto.

Quizás esta frase lleva mi sesgo subjetivo, pero también es precisamente el orden subyacente que Mira @Mira_Network quiere redefinir.

La IA no es tu jefe, no es tu colega, sino una herramienta útil en tus manos, más como una espada que un guerrero usa para ganar, cuanto más afilada, más necesita estar en manos controladas.

Puede ser eficiente, puede ser coherente, puede ser humanizada, pero al final debe ser supervisada, debe firmar en la cadena, debe dejar evidencia, debe aceptar verificación. Esto no es una optimización a nivel de experiencia, sino una restricción estructural, que no permite que la IA crezca por sí sola, se desvíe de las reglas, sino que la obliga a actuar dentro del marco de permisos humanos.

Este es precisamente el punto de diseño de Mira @Mira_Network : normalizar la verificación, hacer que la supervisión sea parte del sistema mismo. Tal vez no necesites entender los detalles de su modelo, ni ser un experto en su estructura gráfica, pero debes darte cuenta de que, sin un mecanismo de verificación, todo lo que dice la IA es como si no lo hubiera dicho, es difícil discernir la verdad, difícil distinguir el bien del mal.

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

Si al llegar aquí estás de acuerdo en que la IA es una herramienta técnica que necesita ser limitada, probada y disciplinada, entonces será difícil que evites a Mira @Mira_Network.

Porque en su mundo, la IA siempre puede hablar, y también debe asumir la responsabilidad, soportar la verificación repetida, y al final, una palabra confiable se presenta ante ti.

11,47K

Parte superior

Clasificación

Favoritos