Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

„Słyszysz, on wciąż mówi bez przerwy, ale tym razem w końcu możemy potwierdzić, co mówi.”

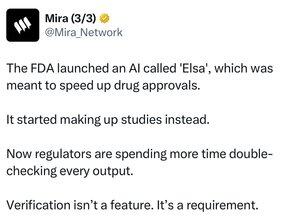

Mira @Mira_Network być może nigdy nie myślała o tym, aby AI było bardziej ludzkie, po prostu chciała, aby AI za każdym razem, gdy coś mówi, zostawiało weryfikowalny dowód.

Niech najsilniejsza „czarna skrzynka” tej epoki stanie się najbardziej przejrzystym bytem na łańcuchu.

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

Mira @Mira_Network: Zainstaluj hamulce w szybko poruszającym się AI, a nie dodawaj mu skrzydeł.

AI może mówić, może pisać kod, może symulować emocje, ale czy można mu zaufać? To jest coś, co Mira @Mira_Network chce rozwiązać.

Odpowiedź Miry jest bardzo jasna: nie chodzi o to, jak bardzo przypomina człowieka, ale o to, czy może zostawić „to zostało powiedziane” jako coś, co każdy może przemyśleć.

To właśnie jest największa różnica między Mira @Mira_Network a większością projektów AI, nie goni za tym, aby pokazać, jak bardzo jest „inteligentna”, ale idzie w przeciwnym kierunku, decydując się na zbudowanie „wiarygodnej” podstawy.

Nie ufa żadnemu modelowi na powierzchni, ale wbudowuje w każdą akcję AI, każdą odpowiedź, każdy osąd weryfikowalne ślady w podstawowej architekturze.

To nie jest optymalizacja doświadczenia, ale definiowanie „odpowiedzi”.

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

AI zawsze jest narzędziem, a nie podmiotem.

Może ta wypowiedź jest moim subiektywnym osądem, ale to właśnie jest podstawowy porządek, który Mira @Mira_Network chce na nowo określić.

AI nie jest twoim szefem, nie jest twoim współpracownikiem, ale narzędziem, które masz w ręku, bardziej jak miecz, którym wojownik używa do zwycięstwa, im ostrzejszy, tym bardziej musi być w kontrolowanej ręce.

Może być wydajne, może być spójne, może być antropomorficzne, ale ostatecznie musi być nadzorowane, musi być podpisane na łańcuchu, musi zostawić dowód, musi być weryfikowane. To nie jest optymalizacja na poziomie doświadczenia, ale strukturalne ograniczenie, które nie pozwala AI na samodzielny rozwój, oderwanie się od zasad, ale zmusza je do działania w ramach ludzkich uprawnień.

To właśnie jest punkt wyjścia projektu Mira @Mira_Network: uczynić weryfikację normą, a nadzór częścią samego systemu. Może nie musisz rozumieć szczegółów jego modelu, nie musisz być ekspertem w jego strukturze grafu, ale musisz zdawać sobie sprawę, że bez mechanizmu weryfikacji wszystko, co mówi AI, jest równoznaczne z tym, że nic nie powiedziało, trudno jest ocenić prawdę, trudno jest rozróżnić dobro od zła.

____ 🁢🁢🁢 ____🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____ 🁢🁢🁢 ____

Jeśli zgadzasz się, że AI to techniczne narzędzie, które musi być ograniczone, udowodnione, ukierunkowane, to trudno będzie ci obejść Mira @Mira_Network.

Bo w jej świecie AI zawsze może mówić, ale musi również ponosić odpowiedzialność, przechodzić przez wielokrotne weryfikacje, a ostatecznie wiarygodne słowo staje przed tobą.

11,47K

Najlepsze

Ranking

Ulubione