热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

宝玉

Prompt Engineer,致力于学习和传播有关 AI、软件工程和工程管理的知识。

今天有个新闻在 Hacker News 上很火,新闻内容是加州失业率攀升至5.5%,全美垫底,科技业步履维艰:“求职市场太残酷了”。

> 根据周五发布的州政府数据,加州七月份的失业率攀升至5.5%,位居全美各州之首。这背后是科技行业和其他办公室工作岗位的持续疲软以及招聘市场的低迷。

新闻将此归因于科技行业的疲软,因为该行业在加州经济中占有举足轻重的地位。这条新闻在 Hacker News 社区上讨论激烈,大家从各自的视角分析了背后的深层原因,远比新闻标题所揭示的更为复杂。

我觉得这个上面的讨论比较好的总结了为什么现在科技行业就业低迷。

1. 首先最核心的观点是:告别“零利率时代”的多重后遗症

这是讨论中最主流、最深刻的观点。许多人认为,当前科技行业的困境并非单一因素造成,而是过去十年“零利率政策”(ZIRP, Zero Interest Rate Policy)时代的终结所引发的连锁反应。

- 资本泡沫破裂:从大约2012年到2022年,极低的利率使得资本异常廉价。大量风险投资(VC)涌入科技行业,催生了无数依赖“烧钱”增长的商业模式,尤其是那些缺乏实际价值的加密货币(Crypto)和元宇宙(Metaverse)公司。随着美联储加息,廉价资金的时代结束,这些公司的资金链断裂,导致大量裁员和倒闭。

- 人才供需失衡:在ZIRP时代,科技行业的高薪神话吸引了大量人才涌入。大学的计算机科学(CS)项目大规模扩招,编程训练营(boot camp)遍地开花,加上技术移民,导致软件工程师的供给在十年间急剧增加。然而,随着资本退潮,需求端(尤其是创业公司)急剧萎缩,造成了严重的人才过剩。

- 生物科技等行业的连带效应:生物科技(Biotech)等同样依赖长期、高风险投资的行业也遭受重创。这些行业对廉价资本的依赖性甚至超过软件行业。ZIRP结束后,VC的资金逐渐枯竭,初创企业在用完“跑道资金”(runway)后无法获得新一轮融资,只能裁员或倒闭。

> (by tqi): “在我看来,现在说‘AI’对软件公司招聘产生实质性影响还为时过早。一个更合理的解释是,在2012到2022年间,软件工程师的人才供给大幅增加... 而在需求端,零利率时代的VC资金主要投向了那些扯淡的加密货币和元宇宙公司,它们大多没能成功,导致现在市场上缺少能够吸纳这些人才的后期或新上市公司。”

2. 远程办公的“双刃剑”:全球化外包的新浪潮

COVID-19 疫情普及了远程办公(Work From Home, WFH),这在当时被许多开发者视为福音,但现在,其负面效应开始显现。

- 为外包铺平道路:当开发者们极力争取完全远程工作的权利时,他们可能没有意识到,这也为公司将岗位外包到成本更低的国家打开了大门。既然大家都是远程,公司为什么不雇佣一个薪资只有美国工程师1/5、同样优秀的印度或东欧工程师呢?

- “回不去了”的办公室:一些评论者认为,科技公司推动的“返回办公室”(Return to Office, RTO)政策,在某种程度上是为了保护本地就业岗位。一旦工作被证明可以100%远程完成,那么它就可以在全球任何地方完成,美国工程师的薪资优势将不复存在。

- 外包质量的争论:也有人反驳说,外包已经持续了几十年,高质量的软件开发仍然需要本地顶尖人才,因为沟通成本、时区差异和文化背景等问题难以解决。但支持外包观点的用户则认为,随着远程协作工具的成熟和管理模式的改进,这些障碍正被逐渐克服。

> (by aurareturn): “我从2022年起就在HN上说:所有支持完全远程工作的北美开发者们,当你的公司决定用海外的人取代你时,你们会大吃一惊的。既然都是远程,公司为什么要花5倍的价钱雇你,而不是一个更努力、更少抱怨的海外员工呢?... 支持返回办公室的命令,从长远看,可能会保住你的职业生涯。”

3. AI的角色:是生产力工具、裁员借口,还是资本“吸血鬼”?

关于人工智能(AI)在这次失业潮中的角色,讨论呈现出复杂的分歧。

- 直接替代效应有限:大多数人同意,目前的AI还无法完全替代有经验的软件工程师。但它已经开始替代一些初级、重复性的工作,比如一些咨询类的小任务。有顾问现身说法,称客户因为可以用ChatGPT解决一些小bug而不再联系他。

- 裁员的“完美借口”:一个普遍的观点是,AI成为了企业裁员和降本增效的“完美借口”。即使裁员的根本原因是经济下行或管理层决策,公司也乐于将其包装成“拥抱AI、提升效率”的战略调整。

- 资本的“黑洞”:AI扮演了另一个关键角色——它吸走了市场上仅存的、本可以流向其他科技领域的风险投资。VC们现在几乎只对AI项目感兴趣,这加剧了非AI领域初创公司的融资困难。

4. 科技行业的“铁锈地带”化?对未来的结构性担忧

部分讨论者从更宏观的视角表达了对未来的忧虑,将科技行业与曾经辉煌后衰落的制造业“铁锈地带”(Rust Belt)相类比。

- 工作岗位流失的重演:正如当年美国将制造业外包给中国一样,现在IT和软件开发工作正在大规模地流向印度、拉美和东欧。这可能导致曾经高薪的软件工程师群体面临长期的结构性失业。

- 政治和社会影响:如果大量中产阶级科技工作岗位消失,可能会引发新的社会和政治问题,就像“铁锈地带”的衰落至今仍在影响美国政治格局一样。

- 移民与签证政策的争议 (H1B/O1):一部分讨论将矛头指向了H1B等工作签证,认为它们被滥用,压低了本地工程师的薪资,并加剧了竞争。另一些人则坚决捍卫技术移民,认为正是这些来自全球的顶尖人才(如滑铁卢大学的毕业生)构成了硅谷的创新基石。

5. 公司管理与文化变迁:“马斯克效应”

一个有趣的观点认为,马斯克对推特(现X)的大规模裁员产生了示范效应。

- 裁员的合理化:当马斯克解雇了推特超过75%的员工后,产品依然能够运转,这让许多CEO开始反思:“既然他能做到,为什么我不能?” 这打破了过去科技公司“人才越多越好”的思维定势,使得大规模裁员在心理上和商业上都变得更容易被接受。

6. 政治与政策因素:税法变更的争议

一条技术性但影响深远的线索是关于美国税法的变更。

- 研发支出摊销规则 (Section 174):2017年特朗普政府的税改法案(TCJA)中有一项条款,要求公司从2022年开始,必须将软件开发的薪资等研发(R&D)支出在五年内分期摊销,而不能像以前一样在当年全额抵扣。这极大地增加了科技公司(尤其是初创公司)的税务负担,抑制了在美国本土的招聘意愿。

- 近期法案的修复作用:最近通过的“重建美好未来法案”(Build Back Better, BBB)部分修正了这一问题,允许国内的研发支出再次立即抵扣。一些评论者认为,他们在7月份左右感受到招聘市场有所回暖,可能与此有关。

最后

从这些讨论来看,现在加州科技行业就业低迷原因还挺复杂,并非单一因素造成的,也不能简单的归结为“AI取代人类”或“行业周期性衰退”,而是零利率时代结束后的经济清算、远程办公带来的全球劳动力市场重构、AI作为新技术和资本磁石的双重冲击、以及特定税收政策变化等多种因素交织在一起的结果。

也不知道啥时候能走出这种困境?或者原因不仅仅是上面讨论的这些

20.7K

转译:为什么大语言模型无法真正构建软件

作者:Conrad Irwin

我花了大量时间做的一件事就是面试软件工程师。这显然是项艰巨的任务,我不敢说自己有什么绝招;但这段经历确实让我有时间去反思,一个高效的软件工程师究竟在做什么。

软件工程的核心循环

当你观察一个真正的行家时,你会发现他们总在循环执行以下几个步骤:

* 构建一个关于需求的心理模型。

* 编写(希望如此?!)能够实现需求的代码。

* 构建一个关于代码实际行为的心理模型。

* 找出两者之间的差异,然后更新代码(或需求)。

完成这些步骤的方式有很多种,但高效工程师的过人之处,就在于他们能够构建并维持清晰的心理模型。

大语言模型表现如何?

平心而论,大语言模型在编写代码方面相当出色。当你指出问题所在时,它们在更新代码方面也做得不错。它们还能做所有真人工程师会做的事:阅读代码、编写并运行测试、添加日志,以及(大概)使用调试器。

但它们无法做到的是,维持清晰的心理模型。

大语言模型会陷入无尽的困惑:它们会假设自己写的代码真的能用;当测试失败时,它们只能猜测是该修复代码还是修复测试;当感到挫败时,它们干脆把所有东西删掉重来。

这与我所期望的工程师特质恰恰相反。

软件工程师会边工作边测试。当测试失败时,他们可以对照自己的心理模型,来决定是修复代码还是修复测试,或者在做决定前先收集更多信息。当他们感到挫败时,可以通过与人交流来寻求帮助。尽管他们有时也会删掉一切重来,但那是在对问题有了更清晰理解之后才会做出的选择。

但很快就行了,对吧?

随着模型能力越来越强,这种情况会改变吗?也许吧??但我认为这需要模型在构建和优化方式上发生根本性的变化。软件工程需要的模型,不仅仅是能生成代码那么简单。

当一个人遇到问题时,他们能够暂时搁置全部的上下文,专注于解决眼前的问题,然后再恢复之前的思绪,回到手头的大问题上。他们也能够在宏观大局和微观细节之间自如切换,暂时忽略细节以关注整体,又能在必要时深入研究局部。我们不会仅仅因为往自己的“上下文窗口”里塞进更多词语,就变得更高效,那只会让我们发疯。

即便我们能处理海量的上下文,我们也知道当前这些生成式模型存在几个严重的问题,这些问题直接影响了它们维持清晰心理模型的能力:

* 上下文遗漏:模型不擅长发现被忽略的上下文信息。

* 新近度偏见:它们在处理上下文窗口时,会受到严重的新近度偏见影响。

* 幻觉:它们常常会“幻想”出一些本不该存在的细节。

这些问题或许并非无法克服,研究人员也正在努力为模型增加记忆,让它们能像我们一样施展类似的思维技巧。但不幸的是,就目前而言,它们(在超出一定复杂度后)实际上无法理解到底发生了什么。

它们无法构建软件,因为它们无法同时维持两个相似的“心理模型”,找出其中的差异,并决定是该更新代码还是更新需求。

那么,现在该怎么办?

显然,大语言模型对软件工程师来说很有用。它们能快速生成代码,并且在整合需求和文档方面表现出色。对于某些任务来说,这已经足够了:需求足够清晰,问题足够简单,它们可以一蹴而就。

话虽如此,对于任何有点复杂度的任务,它们都无法足够精确地维持足够的上下文,来通过迭代最终产出一个可行的解决方案。你,作为软件工程师,依然需要负责确保需求清晰,并保证代码真正实现了其宣称的功能。

在 Zed,我们相信未来人类和 AI 智能体可以协同构建软件。但是,我们坚信(至少在目前)你才是掌控方向盘的驾驶员,而大语言模型只是你触手可及的又一个工具而已。

26.44K

宝玉 已转发

昨天我去 CSDN 的产品经理大会演讲。

三个月前 CSDN 的朋友们邀请我来产品经理大会做演讲的时候,我其实是想拒绝的。

理由是,我的创业公司才刚成立半年,也没有太多真知灼见,可以给大家分享。

不过 CSDN 的朋友们说,没关系,大会还有三个月,还有的是时间,也可以分享一下之前的一些产品经验。

好巧不巧,上周我们发布 FlowSpeech 之后,产品口碑爆棚,MRR 增加3倍,ARR 也突破了一个小目标,更重要的是,我们的用户通过使用产品赚到了真金白银,这是对我们产品力的最佳证明。

所以我昨天在演讲的时候,我跟大家开玩笑说,今天这份 PPT 的含金量已经直线上升了,请大家好好听。

29.89K

“作为一个农民,我只买 organic 的食品;作为AI从业者,我只看非AI生成的内容”😅

马东锡 NLP 🇸🇪8月15日 16:12

不知道你们怎么样,即是作为AI从业者,我本能地排斥输入一切 AI 生成的东西。

Review 代码时,一旦觉得是 AI 写的,我直接写LGTM。

看文章时,只要察觉是 AI 生成的,立刻关掉。

如果网站的UI一看就是AI生成,立刻关掉。

如果播客是AI生成,立刻关掉。

如果短视频是AI生成的,立刻划掉,换成二手车贩子或修理驴蹄子视频。

我觉得让AI生成的内容来愚弄我的多巴胺内啡肽,是对自己肉体和精神的不负责。

AI生成的内容当然有价值,但仅限于人类最终输入和输出的中间物,不应当也不可能长期作为最终形态流通。

59.76K

Vibe Coding 是个糟糕的名词,很有误导性,它最大的意义是借助 AI 做原型开发,能帮助快速确定产品需求。在软件工程中,原型开发的代码通常都是抛弃型的,在正式开发产品时需要重新做系统设计,再编码和实现,Vibe Coding 的结果也是类似的,在确定完需求后,还是需要重新设计再开发。

铁锤人8月14日 21:07

估计很多人不知道什么是 vibe coding?

这个术语是由人工智能大神 Andre Karpathy 创造的,

当你向AI描述问题后,然后它就自己写好代码了。

只适用于那些只有自己会使用的简单周末项目

因为这是不重要的项目,他可以凭感觉行事,而不必真正计划或测试。

👇是梦开始的地方

47.63K

上下文工程中,Agent要借助工具和环境交互获取数据补齐上下文

dontbesilent8月14日 05:13

突然理解了 claude code 和 comet 是咋回事了,为什么 agent 出现在 CLI 和浏览器这两个位置,变成了主流的选择

agent 出现的位置很重要!

开发者喜欢用 claude code,是因为自己的代码可以通过 CLI 控制,代码实际上就是和大模型沟通的上下文,有了代码,我就可以少说话,而且 agent 的工作直接改写了我电脑里面的文件

但是我今天折腾了一圈,发现做自媒体的人就用不上,因为做自媒体的人,电脑里面压根没有东西,核心内容都在 app 和浏览器里面

但是 claude code 又难以获取浏览器和 app 里面的东西,所以核心问题不在于我用 sonnet 还是 opus,而是这个 agent 不应该出现在命令行里面

这个 agent 应该出现在浏览器里面!比如抖音一直吹的抓取小红书数据的 coze 工作流,直接用 comet 就完事了

对于做自媒体的人来说,comet 才是真正的 claude code,因为自媒体人的 agent 必须出现在浏览器

以前的 dia 浏览器相比而言,就显得很蠢,那个不是 agent,是 LLM

如果只是在浏览器里面插一个 LLM,我觉得几乎没有意义

14.94K

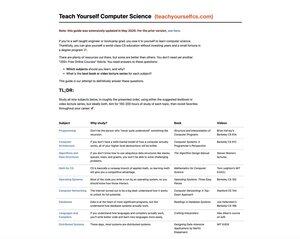

计算机科学自学教程 TeachYourselfCS

如果你是一个自学成才的工程师,或者从编程培训班毕业,那么你很有必要学习计算机科学。幸运的是,不必为此花上数年光阴和不菲费用去攻读一个学位:仅仅依靠自己,你就可以获得世界一流水平的教育💸。

互联网上,到处都有许多的学习资源,然而精华与糟粕并存。你所需要的,不是一个诸如「200+ 免费在线课程」的清单,而是以下问题的答案:

你应当学习 哪些科目,为什么?

对于这些科目,最好的书籍或者视频课程 是什么?

在这份指引中,我们尝试对这些问题做出确定的回答。

Deedy8月14日 09:59

《自学计算机科学》是学习计算机科学的最佳资源。

经过两周的氛围编码,非技术人员感到痛苦。"我真的希望我能懂技术。我就是不知道该如何继续。"

理解计算机科学的任何深度大约需要在9个主题上花费1000小时。

152.06K

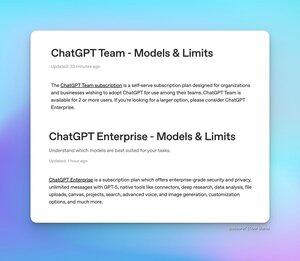

许多朋友都在关心 ChatGPT 团队版(Team)和企业版(Enterprise)的使用限制,现在官方发布了两篇新的常见问题解答(FAQ)文章,对此进行了解释。

* ChatGPT 团队版 - GPT-5 和 GPT-4o 的使用无限制,但具体到不同模型版本有如下限制:

* 每天 200 次 GPT-5 思维(Thinking)请求

* 每周 2800 次 GPT-5 思维迷你(Thinking mini)请求

* 每月 15 次 GPT-5 Pro 请求

* 每 3 小时 500 次 GPT-4.1 请求

* 每天 300 次 o4-mini 和 o3 请求

* ChatGPT 企业版 - GPT-5、GPT-4o 和 GPT-4.1-mini 的使用无限制,但具体到不同模型版本有如下限制:

* 每周 200 次 GPT-5 思维(Thinking)请求

* 每月 15 次 GPT-5 Pro 请求

* 每周 20 次 GPT-4.5 请求

* 每 3 小时 500 次 GPT-4.1 请求

* 每天 300 次 o4-mini 请求

* 每天 100 次 o4-mini-high 请求

* 每周 100 次 o3 请求

* 每月 15 次 o3-pro 请求

FAQ 文章中还提到,目前 GPT-5 思维(Thinking)模型的限制是临时性的,实际上比上面列出的长期限制要更高一些。

Tibor Blaho8月14日 03:17

关于 ChatGPT 团队和企业版的限制,大家都在问 - 有 2 篇新的常见问题解答文章

- ChatGPT 团队 - 无限使用 GPT-5 和 GPT-4o,每天 200 次 GPT-5 思考请求,每周 2800 次 GPT-5 思考迷你请求,每月 15 次 GPT-5 专业请求,每 3 小时 500 次 GPT-4.1 请求,每天 300 次 o4-mini 和 o3 请求

- ChatGPT 企业版 - 无限使用 GPT-5、GPT-4o 和 GPT-4.1-mini,每周 200 次 GPT-5 思考请求,每月 15 次 GPT-5 专业请求,每周 20 次 GPT-4.5 请求,每 3 小时 500 次 GPT-4.1 请求,每天 300 次 o4-mini 请求,每天 100 次 o4-mini-high 请求,每周 100 次 o3 请求,每月 15 次 o3-pro 请求

常见问题解答文章提到,GPT-5 思考请求的限制暂时高于上述长期费率

15.52K

这一点确实:少在Prompt里面说不要做什么,而是应该做什么。大模型这点和人很像,越是不让做的越是容易被吸引注意力

素人极客-Amateur Geek8月13日 23:50

当你想让模型禁止或者不要的时候,

尽量不要直接写!!!

尽量不要直接写!!!

尽量不要直接写!!!

我这里简单讲几种方法:

1、实在要写,不要超过两条

2、把不要,变成要。不要写病句——你要逐句检查,保证每句话前后的铺垫、起转和衔接

3、禁止内容从禁止出现到多次出现。有些事情说一次是记不住的。在我上学的时候,我的日语外教老师说,日本公司有个特别的地方,会不厌其烦的交代一个简单的事情,是为了不让你忘记,哪怕最微末的事情,多次提及也会被记住。你可以在开篇禁止,中间禁止,有关联的地方禁止,最后也禁止。

4、禁止是不要做,那就增加一步,把一件事一次完成,变成两步,在最后加一句话,让你完成上面的动作后,请询问我是否有禁止项,我将会把禁止项发送给你,然后我们开始对禁止项进行筛查,局部修改时,保证其他信息不变。

5、把禁止项目放在第一步。

6、确定你的禁止项是否能禁止。比如你没有给文案确定风格,结果文本出现了AI味儿,那你禁止他用AI口吻也没用,他自己也不知道自己用什么口吻讲!

63.85K

热门

排行

收藏

链上热点

X 热门榜

近期融资

最受认可