Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

宝玉

Prompt Engineer, didedikasikan untuk mempelajari dan menyebarkan pengetahuan tentang AI, rekayasa perangkat lunak, dan manajemen teknik.

Saat ini, ada berita yang sangat populer di Hacker News, konten beritanya adalah bahwa tingkat pengangguran California telah naik menjadi 5,5%, bagian bawah Amerika Serikat, dan industri teknologi sedang berjuang: "Pasar kerja terlalu kejam".

> tingkat pengangguran California naik menjadi 5,5% pada bulan Juli, tertinggi di antara negara bagian mana pun di Amerika Serikat, menurut data pemerintah negara bagian yang dirilis pada hari Jumat. Di balik ini adalah kelemahan pekerjaan yang berkelanjutan di industri teknologi dan pekerjaan kantor lainnya, serta penurunan pasar rekrutmen.

Berita tersebut mengaitkan hal ini dengan kelemahan sektor teknologi, yang merupakan bagian penting dari ekonomi California. Berita itu dibahas hangat di komunitas Hacker News, dan alasan yang mendasari di baliknya dianalisis dari perspektif mereka sendiri, jauh lebih kompleks daripada yang disarankan oleh judulnya.

Saya pikir diskusi ini adalah ringkasan yang baik tentang mengapa pekerjaan di industri teknologi saat ini lamban.

1. Pertama-tama, poin intinya adalah: ucapkan selamat tinggal pada beberapa gejala sisa dari "era suku bunga nol"

Ini adalah poin paling arus utama dan mendalam dalam diskusi. Banyak yang percaya bahwa kesengsaraan industri teknologi saat ini tidak disebabkan oleh satu faktor, melainkan efek riak dari akhir era Zero Interest Rate Policy (ZIRP) dalam dekade terakhir.

- Gelembung modal meledak: Dari sekitar 2012 hingga 2022, suku bunga yang sangat rendah membuat modal sangat murah. Masuknya modal ventura (VC) ke dalam industri teknologi telah melahirkan model bisnis yang tak terhitung jumlahnya yang mengandalkan pertumbuhan "terbakar", terutama perusahaan kripto dan metaverse yang tidak memiliki nilai nyata. Ketika The Fed menaikkan suku bunga, era uang murah berakhir, dan rantai uang untuk perusahaan-perusahaan ini putus, yang menyebabkan banyak PHK dan penutupan.

- Ketidakseimbangan Penawaran dan Permintaan Bakat: Di era ZIRP, mitos gaji tinggi di industri teknologi telah menarik masuknya bakat. Perluasan besar-besaran program ilmu komputer (CS) di universitas, mekarnya kamp pelatihan, dan imigrasi teknis telah menyebabkan peningkatan dramatis dalam pasokan insinyur perangkat lunak selama dekade terakhir. Namun, seiring dengan surutnya modal, sisi permintaan, terutama startup, menyusut tajam, menciptakan surplus bakat yang serius.

- Efek riak di industri seperti bioteknologi: Industri seperti bioteknologi, yang juga mengandalkan investasi jangka panjang dan berisiko tinggi, juga terpukul keras. Industri ini bahkan lebih bergantung pada modal murah daripada industri perangkat lunak. Setelah ZIRP berakhir, dana VC berangsur-angsur mengering, dan startup tidak dapat memperoleh putaran pembiayaan baru setelah kehabisan "dana landasan pacu" (landasan pacu), dan harus memberhentikan karyawan atau bangkrut.

> (oleh tqi): "Menurut pendapat saya, terlalu dini untuk mengatakan bahwa 'AI' memiliki dampak substansial pada perekrutan perusahaan perangkat lunak. Penjelasan yang lebih masuk akal adalah bahwa antara 2012 dan 2022, pasokan bakat untuk insinyur perangkat lunak meningkat secara signifikan... Di sisi permintaan, dana VC di era suku bunga nol terutama diinvestasikan dalam perusahaan cryptocurrency dan metaverse yang tidak masuk akal, yang sebagian besar belum berhasil, mengakibatkan kurangnya perusahaan terdaftar tahap akhir atau baru di pasar yang dapat menyerap talenta ini. ”

2. "Pedang bermata dua" dari pekerjaan jarak jauh: gelombang baru outsourcing global

Pandemi COVID-19 telah mempopulerkan Work From Home (WFH), yang dipandang sebagai anugerah oleh banyak pengembang pada saat itu, namun kini efek negatifnya mulai muncul.

- Membuka jalan untuk outsourcing: Saat pengembang memperjuangkan hak untuk bekerja sepenuhnya dari jarak jauh, mereka mungkin tidak menyadarinya, yang juga membuka pintu bagi perusahaan untuk mengalihdayakan pekerjaan ke negara-negara berbiaya rendah. Karena semua orang terpencil, mengapa tidak mempekerjakan insinyur India atau Eropa Timur yang hanya 1/5 dari insinyur Amerika dan sama baiknya?

- Kantor "Tidak Kembali ke Kantor": Beberapa komentator percaya bahwa kebijakan "Kembali ke Kantor (RTO" yang dipromosikan oleh perusahaan teknologi sebagian ditujukan untuk melindungi pekerjaan lokal). Setelah pekerjaan terbukti 100% jarak jauh, maka itu dapat dilakukan di mana saja di dunia, dan keuntungan gaji untuk insinyur Amerika tidak akan ada lagi.

- Perdebatan Kualitas Outsourcing: Beberapa berpendapat bahwa outsourcing telah berlangsung selama beberapa dekade, dan pengembangan perangkat lunak berkualitas tinggi masih membutuhkan talenta lokal terbaik karena masalah seperti biaya komunikasi, perbedaan zona waktu, dan latar belakang budaya. Namun, mereka yang mendukung perspektif outsourcing percaya bahwa hambatan ini diatasi seiring dengan kematangan alat kolaborasi jarak jauh dan model manajemen meningkat.

> (oleh aurareturn): "Saya telah mengatakan di HN sejak 2022: semua pengembang Amerika Utara yang mendukung pekerjaan jarak jauh sepenuhnya, Anda akan terkejut ketika perusahaan Anda memutuskan untuk mengganti Anda dengan seseorang dari luar negeri. Karena semuanya jarak jauh, mengapa perusahaan harus mempekerjakan Anda dengan harga 5 kali lipat daripada karyawan luar negeri yang bekerja lebih keras dan mengeluh lebih sedikit? ... Mendukung perintah untuk kembali ke kantor dapat menyelamatkan karir Anda dalam jangka panjang. ”

3. Peran AI: Apakah itu alat produktivitas, alasan untuk memberhentikan karyawan, atau "vampir" modal?

Mengenai peran kecerdasan buatan (AI) dalam gelombang kehilangan pekerjaan ini, diskusi menghadirkan kesenjangan yang kompleks.

- Efek penggantian langsung terbatas: Sebagian besar setuju bahwa AI saat ini tidak dapat sepenuhnya menggantikan insinyur perangkat lunak berpengalaman. Tetapi itu telah mulai menggantikan beberapa tugas junior dan berulang, seperti beberapa tugas konsultasi kecil. Seorang konsultan maju dan mengatakan bahwa pelanggan berhenti menghubunginya karena ChatGPT dapat memecahkan beberapa bug kecil.

- "Alasan sempurna" untuk PHK: Keyakinan umum adalah bahwa AI telah menjadi "alasan sempurna" bagi perusahaan untuk memberhentikan karyawan dan mengurangi biaya dan meningkatkan efisiensi. Bahkan jika akar penyebab PHK adalah kemerosotan ekonomi atau keputusan manajemen, perusahaan dengan senang hati mengemasnya sebagai penyesuaian strategis untuk "merangkul AI dan meningkatkan efisiensi".

- "Lubang hitam" modal: AI memainkan peran kunci lainnya – menyedot satu-satunya modal ventura yang tersisa di pasar yang bisa mengalir ke sektor teknologi lain. VC sekarang hampir secara eksklusif tertarik pada proyek AI, yang telah memperburuk kesulitan pembiayaan startup di bidang non-AI.

4. "Zona karat" industri teknologi? Kekhawatiran struktural tentang masa depan

Beberapa panelis menyatakan keprihatinan tentang masa depan dari perspektif yang lebih luas, menarik paralel antara industri teknologi dan "Rust Belt" manufaktur yang dulunya mulia dan kemudian menurun.

- Kehilangan pekerjaan berulang: Sama seperti Amerika Serikat yang mengalihdayakan manufaktur ke China, pekerjaan TI dan pengembangan perangkat lunak sekarang mengalir ke India, Amerika Latin, dan Eropa Timur dalam skala besar. Hal ini dapat menyebabkan pengangguran struktural jangka panjang bagi kelompok insinyur perangkat lunak yang dulunya dibayar dengan baik.

- Dampak Politik dan Sosial: Jika sejumlah besar pekerjaan teknologi kelas menengah menghilang, itu dapat memicu masalah sosial dan politik baru, seperti penurunan Sabuk Karat yang masih memengaruhi lanskap politik Amerika saat ini.

- Kontroversi Kebijakan Imigrasi dan Visa (H1B/O1): Bagian dari diskusi menunjuk pada visa kerja seperti H1B, dengan alasan bahwa visa tersebut disalahgunakan, menurunkan gaji insinyur lokal dan meningkatkan persaingan. Yang lain adalah pembela setia migrasi terampil, dengan alasan bahwa talenta terbaik dari seluruh dunia, seperti lulusan dari University of Waterloo, yang membentuk landasan inovasi di Silicon Valley.

5. Manajemen perusahaan dan perubahan budaya: "Efek Musk"

Sudut pandang yang menarik adalah bahwa Musk telah memiliki efek teladan pada PHK besar-besaran Twitter (sekarang X).

- Rasionalisasi PHK: Ketika Musk memberhentikan lebih dari 75% karyawan Twitter, produk tersebut masih berfungsi, yang membuat banyak CEO merenungkan: "Karena dia bisa melakukannya, mengapa saya tidak bisa?" Ini mematahkan pola pikir "lebih banyak bakat, semakin baik" dari perusahaan teknologi di masa lalu, membuat PHK skala besar lebih dapat diterima baik secara psikologis maupun komersial.

6. Faktor politik dan kebijakan: Kontroversi atas perubahan undang-undang pajak

Petunjuk teknis namun luas adalah tentang perubahan undang-undang pajak AS.

- Aturan Amortisasi Pengeluaran R&D (Bagian 174): Ada ketentuan dalam Undang-Undang Reformasi Pajak (TCJA) pemerintahan Trump pada tahun 2017 yang mengharuskan perusahaan untuk mengamortisasi biaya penelitian dan pengembangan (R&D) seperti gaji pengembangan perangkat lunak dengan mencicil selama lima tahun mulai tahun 2022, daripada dipotong sepenuhnya pada tahun berjalan seperti sebelumnya. Hal ini telah sangat meningkatkan beban pajak pada perusahaan teknologi, terutama startup, dan menghalangi niat perekrutan di Amerika Serikat.

- Efek restoratif dari tagihan baru-baru ini: RUU Build Back Better (BBB) yang baru-baru ini disahkan sebagian memperbaiki masalah ini, memungkinkan pengeluaran R&D domestik segera dipotong lagi. Beberapa komentator percaya bahwa mereka merasakan peningkatan di pasar perekrutan sekitar Juli, yang mungkin ada hubungannya dengan itu.

Akhirnya

Dilihat dari diskusi ini, alasan penurunan lapangan kerja saat ini di industri teknologi California cukup kompleks, tidak disebabkan oleh satu faktor, juga tidak dapat hanya dikaitkan dengan "AI menggantikan manusia" atau "resesi siklus dalam industri", tetapi hasil dari resesi ekonomi setelah berakhirnya era suku bunga nol, restrukturisasi pasar tenaga kerja global yang disebabkan oleh kerja jarak jauh, dampak ganda AI sebagai teknologi baru dan magnet modal, dan perubahan kebijakan pajak tertentu.

Saya tidak tahu kapan saya akan keluar dari kesulitan ini? Atau alasannya bukan hanya yang dibahas di atas

46,42K

Terjemahan: Mengapa model bahasa besar tidak dapat benar-benar membangun perangkat lunak

Oleh Conrad Irwin

Satu hal yang saya habiskan banyak waktu untuk dilakukan adalah mewawancarai insinyur perangkat lunak. Ini jelas merupakan tugas yang sulit, dan saya tidak berani mengatakan bahwa saya memiliki trik apa pun; Tapi itu memberi saya waktu untuk merenungkan apa yang dilakukan insinyur perangkat lunak yang efektif.

Siklus inti rekayasa perangkat lunak

Ketika Anda melihat penikmat sejati, Anda akan melihat bahwa mereka selalu melakukan langkah-langkah berikut dalam satu siklus:

* Bangun model mental kebutuhan.

* Tulis (semoga?!) ) yang mengimplementasikan persyaratan.

* Bangun model mental tentang bagaimana kode Anda benar-benar berperilaku.

* Temukan perbedaan antara keduanya, lalu perbarui kode (atau persyaratan).

Ada banyak cara untuk mencapai langkah-langkah ini, tetapi hal yang hebat tentang insinyur yang efektif adalah kemampuan mereka untuk membangun dan memelihara model mental yang jelas.

Bagaimana kinerja model bahasa besar?

Agar adil, model bahasa besar cukup pandai menulis kode. Mereka juga melakukan pekerjaan yang baik dalam memperbarui kode saat Anda menunjukkan masalahnya. Mereka juga dapat melakukan semua hal yang akan dilakukan oleh insinyur sungguhan: membaca kode, menulis dan menjalankan pengujian, menambahkan log, dan (mungkin) menggunakan debugger.

Tetapi apa yang tidak dapat mereka lakukan adalah mempertahankan model mental yang jelas.

Model bahasa besar akan jatuh ke dalam kebingungan tanpa akhir: mereka akan berasumsi bahwa kode yang mereka tulis benar-benar dapat digunakan; Ketika pengujian gagal, mereka hanya dapat menebak apakah itu kode perbaikan atau pengujian tetap; Ketika mereka frustrasi, mereka hanya memotong semuanya dan memulai dari awal.

Ini adalah kebalikan dari apa yang saya harapkan dari seorang insinyur.

Insinyur perangkat lunak menguji saat mereka bekerja. Ketika tes gagal, mereka dapat menggunakan model mental mereka untuk memutuskan apakah akan memperbaiki kode atau pengujian, atau mengumpulkan lebih banyak informasi sebelum membuat keputusan. Ketika mereka merasa frustrasi, mereka dapat meminta bantuan dengan berkomunikasi dengan orang-orang. Meskipun mereka terkadang menghapus semuanya dan memulai dari awal, itu adalah pilihan yang dibuat setelah pemahaman yang lebih jelas tentang masalah tersebut.

Tapi itu akan segera, bukan?

Akankah ini berubah seiring dengan model menjadi lebih mampu? Mungkin?? Tapi saya pikir ini membutuhkan perubahan mendasar dalam cara model dibangun dan dioptimalkan. Rekayasa perangkat lunak membutuhkan model yang lebih dari sekadar menghasilkan kode.

Ketika seseorang menghadapi masalah, mereka dapat mengesampingkan seluruh konteks untuk sementara dan fokus pada pemecahan masalah yang ada, dan kemudian kembali ke masalah besar yang ada. Mereka juga dapat beralih antara gambaran besar dan detail mikro, untuk sementara mengabaikan detail untuk fokus pada keseluruhan, dan menggali bagian-bagian bila perlu. Kita tidak menjadi lebih produktif hanya dengan menjejalkan lebih banyak kata ke dalam "jendela konteks" kita, itu hanya akan membuat kita gila.

Meskipun kita dapat menangani sejumlah besar konteks, kita tahu bahwa model generatif ini saat ini memiliki beberapa masalah serius yang secara langsung memengaruhi kemampuan mereka untuk mempertahankan model mental yang jelas:

* Penghilangan kontekstual: Model tidak pandai menemukan informasi kontekstual yang diabaikan.

* Bias kekinian: Mereka tunduk pada bias kekinian yang parah saat bekerja dengan jendela konteks.

* Halusinasi: Mereka sering "berfantasi" tentang detail yang seharusnya tidak ada.

Masalah-masalah ini mungkin tidak dapat diatasi, dan para peneliti bekerja untuk menambahkan memori ke model sehingga mereka dapat melatih keterampilan berpikir yang sama seperti yang kita lakukan. Tapi sayangnya, untuk saat ini, mereka (setelah melampaui tingkat kompleksitas tertentu) tidak dapat benar-benar memahami apa yang sebenarnya terjadi.

Mereka tidak dapat membangun perangkat lunak karena mereka tidak dapat mempertahankan dua "model mental" yang serupa pada saat yang sama, mencari tahu perbedaannya, dan memutuskan apakah akan memperbarui kode atau memperbarui persyaratan.

Jadi, bagaimana sekarang?

Jelas, model bahasa besar berguna untuk insinyur perangkat lunak. Mereka menghasilkan kode dengan cepat dan unggul dalam mengintegrasikan persyaratan dan dokumentasi. Untuk beberapa tugas, ini sudah cukup: persyaratannya cukup jelas, masalahnya cukup sederhana sehingga dapat dilakukan dalam semalam.

Karena itu, untuk tugas apa pun yang kompleks, mereka tidak dapat mempertahankan konteks yang cukup tepat untuk mengulangi untuk akhirnya menghasilkan solusi yang layak. Sebagai insinyur perangkat lunak, Anda masih bertanggung jawab untuk memastikan bahwa persyaratannya jelas dan bahwa kode benar-benar memberikan apa yang diklaimnya.

Di Zed, kami percaya pada masa depan di mana manusia dan agen AI dapat membangun perangkat lunak bersama. Namun, kami sangat percaya (setidaknya untuk saat ini) bahwa Anda adalah pengemudi di belakang kemudi, dan bahwa model bahasa besar hanyalah satu alat lagi di ujung jari Anda.

62,82K

宝玉 memposting ulang

Kemarin saya pergi ke Konferensi Manajer Produk CSDN untuk memberikan presentasi.

Ketika teman-teman saya di CSDN mengundang saya untuk memberikan pidato di Konferensi Manajer Produk tiga bulan lalu, saya sebenarnya ingin menolaknya.

Pasalnya, startup saya baru berdiri selama setengah tahun, dan saya tidak memiliki banyak wawasan untuk dibagikan kepada Anda.

Namun, teman-teman CSDN mengatakan bahwa tidak masalah, konferensi masih tiga bulan lagi, dan masih ada waktu, dan kami juga dapat berbagi beberapa pengalaman produk sebelumnya.

Secara kebetulan, setelah kami merilis FlowSpeech minggu lalu, reputasi produk meledak, MRR meningkat 3 kali lipat, ARR juga melanggar tujuan kecil, dan yang lebih penting, pengguna kami menghasilkan uang nyata dengan menggunakan produk tersebut, yang merupakan bukti terbaik dari kekuatan produk kami.

Jadi ketika saya memberikan pidato kemarin, saya bercanda dengan Anda bahwa kandungan emas PPT ini hari ini telah meroket, tolong dengarkan baik-baik.

37,38K

"Sebagai petani, saya hanya membeli makanan organik; Sebagai praktisi AI, saya hanya melihat konten yang tidak dihasilkan AI." 😅

马东锡 NLP 🇸🇪15 Agu, 16.12

Saya tidak tahu tentang Anda, tetapi sebagai praktisi AI, saya secara naluriah menolak memasuki apa pun yang dihasilkan AI.

Saat meninjau kode, begitu saya merasa bahwa itu ditulis oleh AI, saya menulis LGTM secara langsung.

Saat membaca sebuah artikel, selama Anda melihat bahwa itu dihasilkan AI, segera matikan.

Jika UI situs web terlihat dibuat oleh AI, segera matikan.

Jika podcast dibuat AI, segera matikan.

Jika video pendek dibuat oleh AI, segera coret dan ganti dengan dealer mobil bekas atau video perbaikan kuku keledai.

Saya merasa bahwa membiarkan konten yang dihasilkan AI membodohi dopamin endorfin saya tidak bertanggung jawab atas tubuh dan jiwa saya.

Konten yang dihasilkan AI tentu saja berharga, tetapi terbatas pada perantara input dan output manusia akhir, dan tidak boleh dan tidak dapat beredar sebagai bentuk akhir untuk waktu yang lama.

62,01K

Vibe Coding adalah istilah yang buruk dan menyesatkan, dan arti terbesarnya adalah menggunakan AI untuk pembuatan prototipe, yang dapat membantu menentukan persyaratan produk dengan cepat. Dalam rekayasa perangkat lunak, kode untuk pengembangan prototipe biasanya ditinggalkan, dan sistem perlu didesain ulang, dikodekan, dan diimplementasikan saat mengembangkan produk secara resmi.

铁锤人14 Agu, 21.07

Diperkirakan banyak orang yang tidak tahu apa itu Vibe Coding?

Istilah ini diciptakan oleh dewa kecerdasan buatan Andre Karpathy,

Ketika Anda menjelaskan masalah kepada AI, maka ia menulis kodenya sendiri.

Hanya untuk proyek akhir pekan sederhana yang hanya akan Anda gunakan

Karena ini adalah proyek yang tidak penting, dia dapat menindaklanjuti perasaannya tanpa harus benar-benar merencanakan atau menguji.

👇 Di sinilah mimpi dimulai

48,07K

Dalam rekayasa konteks, agen perlu menggunakan alat dan lingkungan untuk mendapatkan data dan melengkapi konteks

dontbesilent14 Agu, 05.13

Saya tiba-tiba mengerti apa itu kode claude dan komet, dan mengapa agen muncul di CLI dan browser, dan telah menjadi pilihan utama

Di mana agen muncul itu penting!

Pengembang suka menggunakan kode claude karena kode mereka dapat dikontrol melalui CLI, dan kode tersebut sebenarnya adalah konteks komunikasi dengan model besar

Tapi saya berjalan-jalan hari ini dan menemukan bahwa orang yang melakukan media mandiri tidak dapat menggunakannya, karena orang yang melakukan media mandiri tidak memiliki apa-apa di komputer mereka sama sekali, dan konten intinya ada di aplikasi dan browser

Namun, kode claude sulit untuk mendapatkan sesuatu di browser dan aplikasi, jadi masalah intinya bukanlah apakah saya menggunakan soneta atau opus, tetapi agen ini tidak boleh muncul di baris perintah

Agen ini akan muncul di browser! Misalnya, Douyin telah meniup alur kerja coze yang menangkap data Xiaohongshu, dan itu dilakukan langsung dengan COMET

Bagi mereka yang melakukan self-media, komet adalah kode claude yang sebenarnya, karena agen self-media person harus muncul di browser

Browser dia sebelumnya bodoh dibandingkan dengan browser dia sebelumnya, yang bukan agen, melainkan LLM

Jika Anda hanya mencolokkan LLM ke browser, saya pikir itu tidak masuk akal

15,1K

Tutorial Belajar Mandiri Ilmu Komputer TeachYourselfCS

Jika Anda seorang insinyur otodidak atau lulus dari kursus pemrograman, maka Anda perlu belajar ilmu komputer. Untungnya, Anda tidak perlu menghabiskan waktu bertahun-tahun dan banyak uang untuk mendapatkan gelar: Anda bisa mendapatkan pendidikan 💸 kelas dunia sendiri.

Di Internet, ada banyak sumber belajar di mana-mana, tetapi esensi dan sampah hidup berdampingan. Alih-alih daftar seperti "200+ kursus online gratis", Anda memerlukan jawaban atas pertanyaan seperti:

Mata pelajaran apa yang harus Anda pelajari dan mengapa?

Apa buku atau kursus video terbaik untuk mata pelajaran ini?

Dalam panduan ini, kami mencoba memberikan jawaban pasti atas pertanyaan-pertanyaan ini.

Deedy14 Agu, 09.59

"Ajari Diri Anda Ilmu Komputer" adalah sumber terbaik untuk belajar CS.

2 minggu dalam pengkodean getaran dan orang-orang non-teknis merasakan sakitnya. "Saya benar-benar berharap saya teknis. Saya hanya tidak tahu bagaimana melanjutkan."

Dibutuhkan ~1000 jam di 9 topik untuk memahami CS dengan kedalaman apa pun.

152,07K

宝玉 memposting ulang

Ini dia teman-temanku~ Saya hanya mendapatkan 20 yuan untuk 3 juta pengguna: ledakan palsu alat AI - ListenHub

Siapa yang tidak akan menceritakan lelucon. Banyak orang tertarik dengan kasus yang saya bagikan di Hard Ground Hacking, dan saya membuat podcast khusus di ListenHub @oran_ge. Anda dapat mendengarkannya~

29,23K

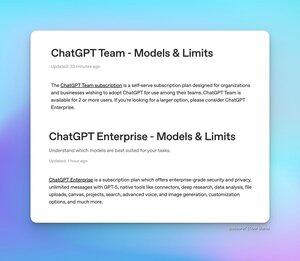

Banyak teman yang khawatir dengan keterbatasan penggunaan ChatGPT Team dan Enterprise, dan sekarang dua artikel umum (FAQ) baru telah dirilis untuk menjelaskan hal ini.

* Edisi Tim ChatGPT - GPT-5 dan GPT-4o tidak terbatas, tetapi ada batasan berikut untuk versi model yang berbeda:

* 200 GPT-5 Permintaan Berpikir per hari

* 2800 GPT-5 Permintaan mini berpikir per minggu

* 15 permintaan GPT-5 Pro per bulan

* 3 permintaan GPT-500 setiap 4,1 jam

* 300 permintaan o4-mini dan o3 per hari

* ChatGPT Enterprise - GPT-5, GPT-4o, dan GPT-4.1-mini tidak terbatas, tetapi ada batasan berikut untuk versi model yang berbeda:

* 200 GPT-5 Permintaan Berpikir per minggu

* 15 permintaan GPT-5 Pro per bulan

* 20 permintaan GPT-4.5 per minggu

* 3 permintaan GPT-500 setiap 4,1 jam

* 300 permintaan o4-mini per hari

* 100 permintaan o4-mini-tinggi per hari

* 100 permintaan o3 per minggu

* 15 permintaan O3-Pro per bulan

Artikel FAQ juga menyebutkan bahwa keterbatasan model GPT-5 Thinking saat ini bersifat sementara dan sebenarnya lebih tinggi dari batas jangka panjang yang tercantum di atas.

Tibor Blaho14 Agu, 03.17

Untuk semua orang yang bertanya tentang batasan ChatGPT Team & Enterprise - ada 2 artikel FAQ baru

- Tim ChatGPT - GPT-5 dan GPT-4O tidak terbatas, 200 GPT-5 Permintaan Pemikiran/hari, 2800 GPT-5 Permintaan mini Pemikiran/minggu, 15 permintaan GPT-5 Pro/bulan, 500 permintaan GPT-4.1/3 jam, 300 permintaan o4-mini dan o3/hari

- ChatGPT Enterprise - GPT-5, GPT-4o dan GPT-4.1-mini tidak terbatas, 200 permintaan Berpikir GPT-5/minggu, 15 permintaan GPT-5 Pro/bulan, 20 permintaan GPT-4.5/minggu, 500 permintaan GPT-4.1/3 jam, 300 permintaan o4-mini/hari, 100 permintaan o4-mini-tinggi/hari, 100 permintaan o3-mini/minggu, 15 permintaan o3-pro/bulan

Artikel FAQ menyebutkan bahwa batas Berpikir GPT-5 untuk sementara lebih tinggi daripada tingkat jangka panjang yang ditunjukkan di atas

15,53K

Ini benar: kurang dalam prompt untuk mengatakan apa yang tidak boleh dilakukan, tetapi apa yang harus dilakukan. Model besar sangat mirip dengan manusia, dan semakin Anda tidak membiarkannya melakukannya, semakin mudah untuk menarik perhatian

素人极客-Amateur Geek13 Agu, 23.50

Ketika Anda ingin membuat model melarang atau tidak,

Cobalah untuk tidak menulis secara langsung!!

Cobalah untuk tidak menulis secara langsung!!

Cobalah untuk tidak menulis secara langsung!!

Berikut adalah beberapa metode sederhana:

1. Tulis lebih dari dua

2. Ubah apa yang tidak Anda inginkan menjadi keinginan. Jangan menulis kalimat yang sakit - Anda harus memeriksa kalimat demi kalimat untuk memastikan bayangan, awal, dan koneksi sebelum dan sesudah setiap kalimat

3. Konten yang dilarang dari dilarang hingga beberapa penampilan. Beberapa hal tidak dapat diingat sekali dikatakan. Ketika saya masih di sekolah, guru asing Jepang saya mengatakan bahwa ada tempat khusus di perusahaan Jepang yang akan bersusah payah menjelaskan hal sederhana agar Anda tidak lupa, bahkan hal-hal terkecil sekalipun, jika Anda menyebutkannya berkali-kali, mereka akan diingat. Anda dapat melarang di awal, di tengah, di mana itu terkait, dan di akhir.

4. Larangannya adalah untuk tidak melakukannya, lalu tambahkan satu langkah, selesaikan satu hal pada satu waktu, ubah menjadi dua langkah, tambahkan kalimat di akhir, biarkan Anda menyelesaikan tindakan di atas, tolong tanyakan kepada saya apakah ada barang terlarang, saya akan mengirimkan barang terlarang kepada Anda, dan kemudian kami akan mulai menyaring barang terlarang, dan ketika memodifikasi sebagian, memastikan bahwa informasi lain tetap tidak berubah.

5. Letakkan barang terlarang pada langkah pertama.

6. Tentukan apakah larangan Anda dapat dilarang. Misalnya, jika Anda tidak menentukan gaya copywriter, dan teksnya memiliki rasa AI, maka tidak ada gunanya Anda melarangnya menggunakan nada AI, dan dia tidak tahu nada apa yang dia gunakan!

63,86K

Teratas

Peringkat

Favorit

Trending onchain

Trending di X

Pendanaan teratas terbaru

Paling terkenal