Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

宝玉

Prompt Engineer, zajmujący się uczeniem się i rozpowszechnianiem wiedzy na temat sztucznej inteligencji, inżynierii oprogramowania i zarządzania inżynierskiego.

Dziś na Hacker News pojawiła się głośna wiadomość, że stopa bezrobocia w Kalifornii wzrosła do 5,5%, co jest najgorszym wynikiem w całych Stanach Zjednoczonych, a sektor technologiczny ma trudności: „Rynek pracy jest zbyt okrutny”.

> Zgodnie z danymi opublikowanymi w piątek przez rząd stanowy, stopa bezrobocia w Kalifornii w lipcu wzrosła do 5,5%, co czyni ją najwyższą wśród wszystkich stanów w USA. Za tym kryje się ciągła słabość sektora technologicznego i innych stanowisk biurowych oraz osłabienie rynku rekrutacji.

Wiadomość ta przypisuje to słabości sektora technologicznego, ponieważ odgrywa on kluczową rolę w gospodarce Kalifornii. Ta wiadomość wywołała intensywną dyskusję w społeczności Hacker News, gdzie każdy z różnych perspektyw analizował głębsze przyczyny, które są znacznie bardziej złożone niż sugeruje tytuł wiadomości.

Uważam, że powyższa dyskusja dobrze podsumowuje, dlaczego obecnie zatrudnienie w sektorze technologicznym jest niskie.

1. Po pierwsze, kluczowym punktem jest: pożegnanie z „erą zerowych stóp procentowych” i jej wieloma konsekwencjami.

To jest najpopularniejszy i najgłębszy punkt w dyskusji. Wiele osób uważa, że obecne trudności sektora technologicznego nie są spowodowane jednym czynnikiem, ale są wynikiem łańcuchowej reakcji wywołanej zakończeniem ery „zerowych stóp procentowych” (ZIRP, Zero Interest Rate Policy) trwającej przez ostatnie dziesięć lat.

- Pęknięcie bańki kapitałowej: Od około 2012 do 2022 roku ekstremalnie niskie stopy procentowe sprawiły, że kapitał stał się niezwykle tani. Ogromne inwestycje venture capital (VC) napłynęły do sektora technologicznego, co doprowadziło do powstania niezliczonych modeli biznesowych opartych na „paleniu pieniędzy”, szczególnie tych, które nie miały rzeczywistej wartości, takich jak kryptowaluty (Crypto) i firmy związane z metawersum (Metaverse). Wraz z podwyżkami stóp procentowych przez Fed, era taniego kapitału dobiegła końca, co doprowadziło do zerwania łańcuchów finansowych tych firm, skutkując masowymi zwolnieniami i bankructwami.

- Nierównowaga popytu i podaży talentów: W erze ZIRP, mit wysokich wynagrodzeń w sektorze technologicznym przyciągnął ogromną liczbę talentów. Programy informatyki na uniwersytetach masowo zwiększyły nabór, a boot campy programistyczne pojawiły się wszędzie, co w połączeniu z imigrantami technologicznymi doprowadziło do gwałtownego wzrostu podaży inżynierów oprogramowania w ciągu dziesięciu lat. Jednak w miarę jak kapitał się wycofywał, popyt (szczególnie ze strony startupów) gwałtownie malał, co spowodowało poważny nadmiar talentów.

- Efekty uboczne w branżach takich jak biotechnologia: Branże takie jak biotechnologia (Biotech), które również polegają na długoterminowych, wysokoryzykownych inwestycjach, również zostały poważnie dotknięte. Te branże są jeszcze bardziej uzależnione od taniego kapitału niż sektor oprogramowania. Po zakończeniu ZIRP, fundusze VC zaczęły się stopniowo wyczerpywać, a startupy, które wyczerpały swoje „fundusze na przetrwanie” (runway), nie mogły uzyskać nowej rundy finansowania, co zmusiło je do zwolnień lub bankructw.

> (by tqi): „Moim zdaniem, obecnie mówienie, że 'AI' ma istotny wpływ na rekrutację w firmach technologicznych, jest przedwczesne. Bardziej rozsądne wyjaśnienie to to, że w latach 2012-2022 znacznie wzrosła podaż inżynierów oprogramowania... A po stronie popytu, fundusze VC w erze zerowych stóp procentowych głównie inwestowały w te bzdurne kryptowaluty i firmy związane z metawersum, z których większość nie odniosła sukcesu, co spowodowało, że na rynku brakuje firm, które mogłyby zatrudnić tych talentów.”

2. „Podwójny miecz” pracy zdalnej: nowa fala globalizacji outsourcingu.

Pandemia COVID-19 spopularyzowała pracę zdalną (Work From Home, WFH), co wówczas było postrzegane przez wielu programistów jako błogosławieństwo, ale teraz zaczynają się ujawniać jej negatywne skutki.

- Ułatwienie outsourcingu: Kiedy programiści walczyli o prawo do pracy w pełni zdalnej, mogli nie zdawać sobie sprawy, że otwiera to również drzwi dla firm do outsourcowania stanowisk do krajów o niższych kosztach. Skoro wszyscy pracują zdalnie, dlaczego firma nie miałaby zatrudnić indyjskiego lub wschodnioeuropejskiego inżyniera, który zarabia tylko 1/5 pensji amerykańskiego inżyniera, a jest równie utalentowany?

- „Nie ma powrotu” do biura: Niektórzy komentatorzy uważają, że polityka „powrotu do biura” (Return to Office, RTO) promowana przez firmy technologiczne jest w pewnym sensie próbą ochrony lokalnych miejsc pracy. Gdy praca może być w 100% wykonywana zdalnie, może być wykonywana z dowolnego miejsca na świecie, a przewaga płacowa amerykańskich inżynierów przestaje istnieć.

- Kontrowersje dotyczące jakości outsourcingu: Inni argumentują, że outsourcing trwa od dziesięcioleci, a wysokiej jakości rozwój oprogramowania nadal wymaga lokalnych talentów, ponieważ problemy takie jak koszty komunikacji, różnice czasowe i tło kulturowe są trudne do rozwiązania. Jednak zwolennicy outsourcingu twierdzą, że wraz z rozwojem narzędzi do współpracy zdalnej i poprawą modeli zarządzania, te przeszkody są stopniowo pokonywane.

> (by aurareturn): „Od 2022 roku mówię na HN: wszyscy północnoamerykańscy programiści wspierający pracę w pełni zdalną będą zszokowani, gdy ich firma zdecyduje się zastąpić ich pracownikami z zagranicy. Skoro wszyscy pracują zdalnie, dlaczego firma miałaby płacić pięć razy więcej za ciebie, a nie za bardziej pracowitego i mniej narzekającego pracownika z zagranicy?... Wspieranie polityki powrotu do biura może w dłuższej perspektywie uratować twoją karierę.”

3. Rola AI: narzędzie wydajności, wymówka do zwolnień, czy „wampir kapitałowy”?

Dyskusja na temat roli sztucznej inteligencji (AI) w tej fali zwolnień ukazuje złożone podziały.

- Ograniczony efekt zastępowania: Większość ludzi zgadza się, że obecna AI nie jest w stanie całkowicie zastąpić doświadczonych inżynierów oprogramowania. Jednak zaczyna ona zastępować niektóre podstawowe, powtarzalne zadania, takie jak drobne zadania konsultingowe. Niektórzy konsultanci przyznają, że klienci przestali się z nimi kontaktować, ponieważ mogą rozwiązać drobne błędy za pomocą ChatGPT.

- „Idealna wymówka” do zwolnień: Powszechnym poglądem jest to, że AI stała się „idealną wymówką” dla firm do zwolnień i redukcji kosztów. Nawet jeśli podstawowym powodem zwolnień jest spowolnienie gospodarcze lub decyzje zarządu, firmy chętnie przedstawiają to jako strategiczną zmianę „przyjęcia AI i zwiększenia efektywności”.

- „Czarna dziura” kapitału: AI odgrywa jeszcze jedną kluczową rolę - pochłania pozostały na rynku kapitał, który mógłby trafić do innych dziedzin technologicznych. VC obecnie interesują się niemal wyłącznie projektami AI, co pogłębia trudności w finansowaniu startupów w innych dziedzinach.

4. „Rdzewienie” sektora technologicznego? Strukturalne obawy o przyszłość.

Niektórzy dyskutanci wyrażają obawy o przyszłość z szerszej perspektywy, porównując sektor technologiczny do niegdyś świetlanej, a teraz podupadłej branży produkcyjnej „rdzewiejącego pasa” (Rust Belt).

- Powtórka utraty miejsc pracy: Tak jak kiedyś USA outsourcowały przemysł do Chin, tak teraz prace w IT i rozwoju oprogramowania masowo przenoszą się do Indii, Ameryki Łacińskiej i Europy Wschodniej. Może to prowadzić do długoterminowego strukturalnego bezrobocia wśród niegdyś wysoko opłacanych inżynierów oprogramowania.

- Polityczne i społeczne skutki: Jeśli zniknie wiele miejsc pracy w średniej klasie w sektorze technologicznym, może to wywołać nowe problemy społeczne i polityczne, podobnie jak upadek „rdzewiejącego pasa” wciąż wpływa na amerykański krajobraz polityczny.

- Kontrowersje dotyczące imigracji i polityki wizowej (H1B/O1): Część dyskusji kieruje uwagę na wizy pracownicze, takie jak H1B, które są uważane za nadużywane, co obniża wynagrodzenia lokalnych inżynierów i zwiększa konkurencję. Inni stanowczo bronią imigracji technologicznej, twierdząc, że to właśnie ci najlepsi z całego świata (jak absolwenci Uniwersytetu Waterloo) stanowią fundament innowacji w Dolinie Krzemowej.

5. Zarządzanie firmą i zmiany kulturowe: „efekt Muska”.

Interesującym punktem jest to, że masowe zwolnienia w Twitterze (obecnie X) przez Muska miały efekt demonstracyjny.

- Uzasadnienie zwolnień: Kiedy Musk zwolnił ponad 75% pracowników Twittera, produkt nadal działał, co skłoniło wielu CEO do refleksji: „Skoro on może to zrobić, dlaczego ja nie mogę?” To przełamało dotychczasowe myślenie w firmach technologicznych, że „im więcej talentów, tym lepiej”, co sprawiło, że masowe zwolnienia stały się psychologicznie i biznesowo łatwiejsze do zaakceptowania.

6. Polityczne i prawne czynniki: kontrowersje dotyczące zmian w prawie podatkowym.

Jednym z technicznych, ale mających dalekosiężne skutki wątków jest zmiana w amerykańskim prawie podatkowym.

- Zasady amortyzacji wydatków na badania i rozwój (Sekcja 174): W 2017 roku w ramach reformy podatkowej rządu Trumpa (TCJA) wprowadzono przepis, który wymaga od firm, aby od 2022 roku amortyzowały wydatki na wynagrodzenia i inne wydatki związane z badaniami i rozwojem (R&D) w ciągu pięciu lat, a nie jak wcześniej w pełnej wysokości w danym roku. To znacznie zwiększyło obciążenie podatkowe firm technologicznych (szczególnie startupów) i ograniczyło ich chęć do zatrudniania w USA.

- Ostatnie poprawki ustawodawcze: Niedawno uchwalona ustawa „Budujmy lepszą przyszłość” (Build Back Better, BBB) częściowo naprawiła ten problem, pozwalając na ponowne natychmiastowe odliczenie krajowych wydatków na badania i rozwój. Niektórzy komentatorzy zauważyli, że w lipcu poczuli, że rynek rekrutacji się ożywia, co może być z tym związane.

Na koniec

Z tych dyskusji wynika, że obecne trudności w zatrudnieniu w kalifornijskim sektorze technologicznym są dość złożone i nie są spowodowane jednym czynnikiem, ani nie można ich po prostu sprowadzić do „AI zastępującej ludzi” lub „cyklicznego spadku branży”, ale są wynikiem zakończenia ery zerowych stóp procentowych, rekonstrukcji globalnego rynku pracy spowodowanej pracą zdalną, podwójnego uderzenia AI jako nowej technologii i magnesu kapitałowego oraz zmian w polityce podatkowej.

Nie wiem, kiedy uda się wyjść z tej sytuacji? A może przyczyny są nie tylko te, które zostały omówione powyżej.

46,38K

Transkrypcja: Dlaczego duże modele językowe nie mogą naprawdę budować oprogramowania

Autor: Conrad Irwin

Spędziłem dużo czasu na przeprowadzaniu rozmów kwalifikacyjnych z inżynierami oprogramowania. To oczywiście trudne zadanie, nie mogę powiedzieć, że mam na to jakąś tajną metodę; ale to doświadczenie dało mi czas na refleksję nad tym, co naprawdę robi efektywny inżynier oprogramowania.

Podstawowa pętla inżynierii oprogramowania

Kiedy obserwujesz prawdziwego fachowca, zauważysz, że zawsze wykonuje następujące kroki w pętli:

* Buduje mentalny model wymagań.

* Pisze (miejmy nadzieję?!) kod, który spełnia te wymagania.

* Buduje mentalny model rzeczywistego zachowania kodu.

* Odkrywa różnice między tymi dwoma modelami, a następnie aktualizuje kod (lub wymagania).

Istnieje wiele sposobów na wykonanie tych kroków, ale wyjątkowość efektywnych inżynierów polega na tym, że potrafią budować i utrzymywać jasne mentalne modele.

Jak radzą sobie duże modele językowe?

Szczerze mówiąc, duże modele językowe są całkiem dobre w pisaniu kodu. Kiedy wskazujesz problem, dobrze radzą sobie z aktualizowaniem kodu. Potrafią robić wszystko, co robią prawdziwi inżynierowie: czytać kod, pisać i uruchamiać testy, dodawać logi oraz (prawdopodobnie) korzystać z debuggera.

Jednak nie potrafią utrzymać jasnego mentalnego modelu.

Duże modele językowe wpadają w niekończące się zamieszanie: zakładają, że kod, który napisały, naprawdę działa; gdy testy zawodzą, mogą tylko zgadywać, czy powinny naprawić kod, czy test; gdy czują frustrację, po prostu usuwają wszystko i zaczynają od nowa.

To jest dokładnie przeciwieństwo cech, których oczekuję od inżyniera.

Inżynierowie oprogramowania testują podczas pracy. Gdy testy zawodzą, mogą porównać swoje mentalne modele, aby zdecydować, czy naprawić kod, czy test, lub zebrać więcej informacji przed podjęciem decyzji. Gdy czują frustrację, mogą szukać pomocy, rozmawiając z innymi. Chociaż czasami również usuwają wszystko i zaczynają od nowa, robią to dopiero po uzyskaniu jaśniejszego zrozumienia problemu.

Ale to szybko się zmieni, prawda?

Czy sytuacja zmieni się, gdy modele będą coraz silniejsze? Może tak?? Ale myślę, że wymagałoby to fundamentalnej zmiany w sposobie budowania i optymalizacji modeli. Model, którego potrzebuje inżynieria oprogramowania, to coś więcej niż tylko generowanie kodu.

Kiedy człowiek napotyka problem, potrafi tymczasowo odłożyć cały kontekst na bok, skupić się na rozwiązaniu bieżącego problemu, a następnie wrócić do wcześniejszych myśli i większego problemu. Potrafią również swobodnie przełączać się między makro a mikro perspektywą, tymczasowo ignorując szczegóły, aby skupić się na całości, a w razie potrzeby zagłębiając się w detale. Nie staniemy się bardziej efektywni tylko dlatego, że wpychamy więcej słów do naszego "okna kontekstowego"; to tylko doprowadzi nas do szaleństwa.

Nawet jeśli potrafimy radzić sobie z ogromnym kontekstem, wiemy, że obecne modele generatywne mają kilka poważnych problemów, które bezpośrednio wpływają na ich zdolność do utrzymania jasnych mentalnych modeli:

* Pominięcie kontekstu: modele nie radzą sobie z odkrywaniem pominiętych informacji kontekstowych.

* Bias nowości: mają poważny problem z biasem nowości podczas przetwarzania okna kontekstowego.

* Halucynacje: często "halucynują" szczegóły, które nie powinny istnieć.

Te problemy mogą nie być nie do pokonania, a badacze pracują nad dodaniem pamięci do modeli, aby mogły stosować podobne techniki myślenia jak my. Niestety, na chwilę obecną (po przekroczeniu pewnej złożoności) nie są w stanie zrozumieć, co się dzieje.

Nie potrafią budować oprogramowania, ponieważ nie mogą jednocześnie utrzymać dwóch podobnych "mentalnych modeli", znaleźć różnice między nimi i zdecydować, czy zaktualizować kod, czy wymagania.

Co teraz zrobić?

Oczywiście, duże modele językowe są bardzo przydatne dla inżynierów oprogramowania. Potrafią szybko generować kod i doskonale radzą sobie z integrowaniem wymagań i dokumentacji. Dla niektórych zadań to już wystarczy: wymagania są wystarczająco jasne, a problem wystarczająco prosty, aby mogły to zrobić za jednym razem.

Mówiąc to, w przypadku jakiegokolwiek zadania o pewnym stopniu złożoności, nie potrafią wystarczająco precyzyjnie utrzymać wystarczającego kontekstu, aby poprzez iterację ostatecznie wyprodukować wykonalne rozwiązanie. Ty, jako inżynier oprogramowania, nadal musisz być odpowiedzialny za zapewnienie jasności wymagań i upewnienie się, że kod rzeczywiście realizuje deklarowane funkcje.

W Zed wierzymy, że w przyszłości ludzie i inteligencje AI mogą współpracować w budowaniu oprogramowania. Jednak jesteśmy przekonani (przynajmniej na chwilę obecną), że to ty jesteś kierowcą trzymającym kierownicę, a duże modele językowe to tylko kolejne narzędzie w twoim zasięgu.

62,8K

Użytkownik 宝玉 udostępnił ponownie

Wczoraj wygłosiłem przemówienie na konferencji menedżerów produktów CSDN.

Trzy miesiące temu, gdy przyjaciele z CSDN zaprosili mnie do wygłoszenia przemówienia na konferencji menedżerów produktów, tak naprawdę chciałem odmówić.

Powód był taki, że moja firma startupowa dopiero co powstała pół roku temu i nie miałem zbyt wielu cennych spostrzeżeń, którymi mógłbym się podzielić.

Jednak przyjaciele z CSDN powiedzieli, że nie ma sprawy, do konferencji zostały jeszcze trzy miesiące, zawsze można podzielić się wcześniejszymi doświadczeniami produktowymi.

Jak na złość, w zeszłym tygodniu po wydaniu FlowSpeech, nasz produkt zdobył ogromne uznanie, MRR wzrosło trzykrotnie, a ARR również przekroczyło mały cel, co ważniejsze, nasi użytkownicy zarobili prawdziwe pieniądze dzięki korzystaniu z produktu, co jest najlepszym dowodem na naszą siłę produktu.

Dlatego wczoraj podczas przemówienia żartowałem, że wartość tej prezentacji PPT wzrosła wprost proporcjonalnie, proszę wszystkich o uważne słuchanie.

37,37K

„Jako rolnik, kupuję tylko organiczne jedzenie; jako pracownik AI, oglądam tylko treści, które nie są generowane przez AI”😅

马东锡 NLP 🇸🇪15 sie, 16:12

Nie wiem, jak wy, ale jako osoba pracująca w AI, instynktownie odrzucam wszystko, co jest generowane przez AI.

Podczas przeglądania kodu, gdy tylko pomyślę, że to napisane przez AI, od razu piszę LGTM.

Gdy czytam artykuł, jeśli tylko zauważę, że jest generowany przez AI, natychmiast go zamykam.

Jeśli UI strony internetowej wygląda na generowane przez AI, natychmiast ją zamykam.

Jeśli podcast jest generowany przez AI, natychmiast go zamykam.

Jeśli krótki film jest generowany przez AI, natychmiast go pomijam, zamieniając na filmik o handlarzach używanych samochodów lub naprawie kopyt osłów.

Uważam, że pozwalanie treściom generowanym przez AI na oszukiwanie mojego dopaminy i endorfin jest nieodpowiedzialne wobec mojego ciała i umysłu.

Oczywiście treści generowane przez AI mają wartość, ale tylko jako pośrednie materiały, które są ostatecznie wprowadzane i wyprowadzane przez ludzi, nie powinny i nie mogą być długoterminowo wykorzystywane jako ostateczna forma obiegu.

62,01K

Vibe Coding to złe określenie, bardzo mylące. Jego największe znaczenie polega na wykorzystaniu AI do prototypowania, co może pomóc w szybkim określeniu wymagań produktu. W inżynierii oprogramowania kod prototypowy jest zazwyczaj jednorazowy, a podczas formalnego rozwoju produktu konieczne jest ponowne zaprojektowanie systemu, a następnie ponowne kodowanie i wdrażanie. Wynik Vibe Coding jest podobny; po określeniu wymagań nadal trzeba ponownie zaprojektować i opracować.

铁锤人14 sie, 21:07

Szacuję, że wiele osób nie wie, czym jest vibe coding?

Termin ten został stworzony przez geniusza sztucznej inteligencji Andre Karpathy'ego,

gdy opisujesz problem AI, a następnie ono samo pisze kod.

Dotyczy to tylko prostych projektów weekendowych, które są używane tylko przez ciebie.

Ponieważ to nieistotny projekt, może działać na podstawie intuicji, nie musząc naprawdę planować ani testować.

👇 To jest miejsce, gdzie zaczyna się marzenie.

48,06K

W kontekście inżynierii, agent musi korzystać z narzędzi i interakcji ze środowiskiem, aby uzyskać dane i uzupełnić kontekst.

dontbesilent14 sie, 05:13

Nagle zrozumiałem, o co chodzi z claude code i comet, dlaczego agent pojawia się w CLI i przeglądarkach, stając się głównym wyborem.

Miejsce, w którym pojawia się agent, jest bardzo ważne!

Programiści lubią używać claude code, ponieważ ich kod można kontrolować za pomocą CLI, a kod w rzeczywistości jest kontekstem do komunikacji z dużym modelem. Mając kod, mogę mniej mówić, a praca agenta bezpośrednio zmienia pliki na moim komputerze.

Jednak dzisiaj, po wielu próbach, odkryłem, że osoby zajmujące się mediami społecznościowymi nie mogą z tego korzystać, ponieważ nie mają nic na komputerze, a ich kluczowe treści znajdują się w aplikacjach i przeglądarkach.

Jednak claude code jest trudny do uzyskania z rzeczy w przeglądarkach i aplikacjach, więc kluczowy problem nie polega na tym, czy używam sonnet, czy opus, ale na tym, że ten agent nie powinien pojawiać się w wierszu poleceń.

Ten agent powinien pojawić się w przeglądarkach! Na przykład, to, co Douyin ciągle promuje, czyli workflow coze do zbierania danych z Xiaohongshu, można by po prostu załatwić za pomocą comet.

Dla osób zajmujących się mediami społecznościowymi, comet to prawdziwy claude code, ponieważ agent dla twórców treści musi pojawić się w przeglądarkach.

W porównaniu do wcześniejszej przeglądarki dia, wydaje się ona bardzo głupia, to nie jest agent, to LLM.

Jeśli tylko w przeglądarkach wstawimy LLM, to uważam, że to prawie nie ma sensu.

15,09K

Samouczek z informatyki TeachYourselfCS

Jeśli jesteś inżynierem, który samodzielnie zdobył wiedzę, lub ukończyłeś kurs programowania, to zdecydowanie powinieneś nauczyć się informatyki. Na szczęście nie musisz poświęcać lat i dużych pieniędzy na zdobycie dyplomu: polegając tylko na sobie, możesz uzyskać edukację na światowym poziomie💸.

W Internecie jest wiele zasobów do nauki, jednak wśród nich są zarówno skarby, jak i bzdury. To, czego potrzebujesz, to nie lista „200+ darmowych kursów online”, ale odpowiedzi na następujące pytania:

Jakie przedmioty powinieneś studiować i dlaczego?

Jakie są najlepsze książki lub kursy wideo dotyczące tych przedmiotów?

W tym przewodniku staramy się udzielić jednoznacznych odpowiedzi na te pytania.

Deedy14 sie, 09:59

"Naucz się samodzielnie informatyki" to najlepszy zasób do nauki CS.

Po 2 tygodniach kodowania w vibe, osoby nietechniczne odczuwają ból. "Naprawdę chciałbym być techniczny. Po prostu nie wiem, jak postępować."

Zajmuje to około 1000 godzin w 9 tematach, aby zrozumieć CS w jakiejkolwiek głębokości.

152,06K

Użytkownik 宝玉 udostępnił ponownie

Przybyli przyjaciele~ Mam 3 miliony użytkowników, a zarobiłem tylko 20 zł: Fałszywy rozkwit narzędzi AI - ListenHub

Opowiadanie dowcipów, kto tego nie potrafi? Wcześniej wiele osób było zainteresowanych przypadkiem, który dzieliłem na Hardland Hackers, więc specjalnie użyłem @oran_ge i stworzyłem podcast z dowcipami na listenhub. Możecie posłuchać~

29,23K

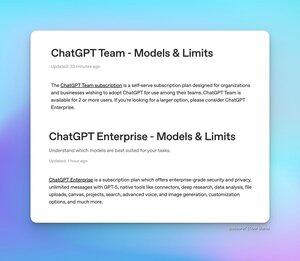

Wielu przyjaciół interesuje się ograniczeniami użytkowania wersji zespołowej (Team) i wersji przedsiębiorstwowej (Enterprise) ChatGPT. Teraz oficjalnie opublikowano dwa nowe artykuły z najczęściej zadawanymi pytaniami (FAQ), które to wyjaśniają.

* Wersja zespołowa ChatGPT - Użycie GPT-5 i GPT-4o jest nieograniczone, ale w zależności od różnych wersji modeli obowiązują następujące ograniczenia:

* 200 zapytań dziennie do GPT-5 myślenia (Thinking)

* 2800 zapytań tygodniowo do GPT-5 myślenia mini (Thinking mini)

* 15 zapytań miesięcznie do GPT-5 Pro

* 500 zapytań co 3 godziny do GPT-4.1

* 300 zapytań dziennie do o4-mini i o3

* Wersja przedsiębiorstwowa ChatGPT - Użycie GPT-5, GPT-4o i GPT-4.1-mini jest nieograniczone, ale w zależności od różnych wersji modeli obowiązują następujące ograniczenia:

* 200 zapytań tygodniowo do GPT-5 myślenia (Thinking)

* 15 zapytań miesięcznie do GPT-5 Pro

* 20 zapytań tygodniowo do GPT-4.5

* 500 zapytań co 3 godziny do GPT-4.1

* 300 zapytań dziennie do o4-mini

* 100 zapytań dziennie do o4-mini-high

* 100 zapytań tygodniowo do o3

* 15 zapytań miesięcznie do o3-pro

W artykule FAQ wspomniano również, że obecne ograniczenia modelu GPT-5 myślenia (Thinking) są tymczasowe i w rzeczywistości są wyższe niż długoterminowe ograniczenia wymienione powyżej.

Tibor Blaho14 sie, 03:17

Dla wszystkich pytających o limity zespołu i przedsiębiorstwa ChatGPT - są 2 nowe artykuły FAQ

- ChatGPT Team - nieograniczone GPT-5 i GPT-4o, 200 zapytań GPT-5 Thinking/dzień, 2800 zapytań mini GPT-5 Thinking/tydzień, 15 zapytań GPT-5 Pro/miesiąc, 500 zapytań GPT-4.1/3 godziny, 300 zapytań o4-mini i o3/dzień

- ChatGPT Enterprise - nieograniczone GPT-5, GPT-4o i GPT-4.1-mini, 200 zapytań GPT-5 Thinking/tydzień, 15 zapytań GPT-5 Pro/miesiąc, 20 zapytań GPT-4.5/tydzień, 500 zapytań GPT-4.1/3 godziny, 300 zapytań o4-mini/dzień, 100 zapytań o4-mini-high/dzień, 100 zapytań o3/tydzień, 15 zapytań o3-pro/miesiąc

Artykuł FAQ wspomina, że limity GPT-5 Thinking są tymczasowo wyższe niż długoterminowe stawki pokazane powyżej.

15,52K

To prawda: mniej mów o tym, czego nie należy robić w Prompt, a więcej o tym, co należy robić. Duże modele są pod tym względem podobne do ludzi, im bardziej coś jest zabronione, tym bardziej przyciąga uwagę.

素人极客-Amateur Geek13 sie, 23:50

Kiedy chcesz, aby model był zablokowany lub nie działał,

staraj się nie pisać bezpośrednio!!!

staraj się nie pisać bezpośrednio!!!

staraj się nie pisać bezpośrednio!!!

Tutaj krótko omówię kilka metod:

1. Jeśli musisz pisać, nie przekraczaj dwóch punktów.

2. Zmień "nie" na "tak". Nie pisz błędnych zdań — musisz sprawdzić każde zdanie, aby upewnić się, że wprowadzenie, przejścia i połączenia są poprawne.

3. Zakaz treści powinien przechodzić od zakazu do wielokrotnego wystąpienia. Niektóre rzeczy nie zostaną zapamiętane po jednym wspomnieniu. Kiedy byłem w szkole, mój nauczyciel języka japońskiego mówił, że w japońskich firmach jest coś szczególnego, co polega na tym, że nieustannie powtarzają prostą rzecz, abyś jej nie zapomniał, nawet najdrobniejsze szczegóły będą zapamiętane po wielokrotnym wspomnieniu. Możesz zakazać na początku, w środku, w powiązanych miejscach, a na końcu również zakazać.

4. Jeśli zakaz to "nie rób", dodaj krok, aby wykonać jedną rzecz w dwóch krokach, a na końcu dodaj zdanie, w którym po wykonaniu powyższej czynności zapytasz mnie, czy są jakieś zakazy, a ja prześlę ci zakazy, a potem zaczniemy przeszukiwać zakazy, przy lokalnych modyfikacjach upewnij się, że inne informacje pozostają niezmienione.

5. Umieść zakazy w pierwszym kroku.

6. Upewnij się, że twoje zakazy mogą być skuteczne. Na przykład, jeśli nie określiłeś stylu tekstu, a tekst ma "smak AI", to zakazanie mu używania tonu AI nie ma sensu, ponieważ on sam nie wie, jakim tonem mówi!

63,85K

Najlepsze

Ranking

Ulubione

Trendy onchain

Trendy na X

Niedawne największe finansowanie

Najbardziej godne uwagi