Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

宝玉

Prompt Engineer, der sich dem Erlernen und Verbreiten von Wissen über KI, Software-Engineering und Engineering-Management widmet.

Heute gab es eine Nachricht, die auf Hacker News sehr populär war. Der Inhalt der Nachricht ist, dass die Arbeitslosenquote in Kalifornien auf 5,5 % gestiegen ist, was den letzten Platz in den USA bedeutet, und die Technologiebranche hat es schwer: "Der Arbeitsmarkt ist zu brutal."\n> Laut den am Freitag veröffentlichten Daten der Staatsregierung ist die Arbeitslosenquote in Kalifornien im Juli auf 5,5 % gestiegen und liegt damit an der Spitze aller Bundesstaaten in den USA. Dies ist auf die anhaltende Schwäche der Technologiebranche und anderer Büroarbeitsplätze sowie auf die Flaute auf dem Rekrutierungsmarkt zurückzuführen.\n\nDie Nachricht führt dies auf die Schwäche der Technologiebranche zurück, da diese Branche eine entscheidende Rolle in der kalifornischen Wirtschaft spielt. Diese Nachricht wurde in der Hacker News-Community intensiv diskutiert, und die Leute analysierten aus verschiedenen Perspektiven die tieferliegenden Ursachen, die viel komplexer sind als der Titel der Nachricht vermuten lässt.\n\nIch denke, die Diskussion oben fasst gut zusammen, warum die Beschäftigung in der Technologiebranche derzeit schwach ist.\n\n1. Zunächst ist der zentrale Punkt: Die multiplen Nachwirkungen des Abschieds von der "Nullzinsära"\n\nDies ist der am weitesten verbreitete und tiefgründigste Punkt in der Diskussion. Viele glauben, dass die gegenwärtigen Schwierigkeiten der Technologiebranche nicht auf einen einzelnen Faktor zurückzuführen sind, sondern auf die Kettenreaktion, die durch das Ende der "Nullzins-Politik" (ZIRP, Zero Interest Rate Policy) in den letzten zehn Jahren ausgelöst wurde.\n\n- Platzen der Kapitalblase: Von etwa 2012 bis 2022 machten extrem niedrige Zinsen Kapital außergewöhnlich billig. Eine große Menge an Risikokapital (VC) strömte in die Technologiebranche und schuf unzählige Geschäftsmodelle, die auf "Geldverbrennung" angewiesen waren, insbesondere solche, die keinen tatsächlichen Wert hatten, wie Kryptowährungen (Crypto) und Metaverse-Unternehmen. Mit den Zinserhöhungen der Federal Reserve endete die Ära des billigen Kapitals, was zu einer Unterbrechung der Finanzierung dieser Unternehmen führte, was zu massiven Entlassungen und Insolvenzen führte.\n\n- Ungleichgewicht zwischen Angebot und Nachfrage an Talenten: In der ZIRP-Ära zog der Mythos von hohen Gehältern in der Technologiebranche eine große Anzahl von Talenten an. Die Computerwissenschaftsprogramme an Universitäten wurden massiv erweitert, Bootcamps für Programmierung schossen wie Pilze aus dem Boden, und zusammen mit technischen Einwanderern führte dies zu einem dramatischen Anstieg des Angebots an Software-Ingenieuren innerhalb von zehn Jahren. Doch mit dem Rückgang des Kapitals schrumpfte die Nachfrage (insbesondere bei Startups) dramatisch, was zu einem ernsthaften Überangebot an Talenten führte.\n\n- Kaskadeneffekte in Branchen wie Biotechnologie: Branchen wie Biotechnologie, die ebenfalls auf langfristige, risikobehaftete Investitionen angewiesen sind, wurden ebenfalls schwer getroffen. Diese Branchen sind sogar noch abhängiger von billigem Kapital als die Softwarebranche. Nach dem Ende der ZIRP versiegten die VC-Mittel allmählich, und Startups konnten nach dem Verbrauch ihrer "Betriebsfinanzierung" (runway) keine neue Finanzierungsrunde mehr erhalten und mussten entlassen oder schließen.\n\n> (von tqi): "Meiner Meinung nach ist es jetzt zu früh zu sagen, dass 'KI' einen wesentlichen Einfluss auf die Rekrutierung von Softwareunternehmen hat. Eine vernünftigere Erklärung ist, dass zwischen 2012 und 2022 das Angebot an Software-Ingenieuren erheblich gestiegen ist... Während die Nachfrage, insbesondere bei Startups, stark zurückgegangen ist, flossen die VC-Mittel der Nullzinsära hauptsächlich in diese absurden Kryptowährungen und Metaverse-Unternehmen, von denen die meisten nicht erfolgreich waren, was dazu führte, dass es jetzt an späteren oder neu gelisteten Unternehmen mangelt, die diese Talente aufnehmen können."\n\n2. Die "Zwei-Seiten-Medaille" des Homeoffice: Eine neue Welle der globalen Outsourcing\n\nDie COVID-19-Pandemie hat das Homeoffice (Work From Home, WFH) populär gemacht, was damals von vielen Entwicklern als Segen angesehen wurde, aber jetzt beginnen die negativen Effekte sichtbar zu werden.\n\n- Den Weg für Outsourcing ebnen: Als Entwickler um das Recht auf vollständige Fernarbeit kämpften, haben sie möglicherweise nicht erkannt, dass dies auch den Unternehmen die Tür öffnete, Stellen in kostengünstigere Länder auszulagern. Wenn alle remote arbeiten, warum sollte das Unternehmen dann nicht einen indischen oder osteuropäischen Ingenieur einstellen, der nur ein Fünftel des Gehalts eines amerikanischen Ingenieurs verdient und ebenso talentiert ist?\n\n- "Zurück geht nicht": Einige Kommentatoren glauben, dass die von Technologieunternehmen vorangetriebene Politik der "Rückkehr ins Büro" (Return to Office, RTO) in gewissem Maße dazu dient, lokale Arbeitsplätze zu schützen. Sobald sich herausstellt, dass die Arbeit zu 100 % remote erledigt werden kann, kann sie überall auf der Welt erledigt werden, und der Gehaltsvorteil amerikanischer Ingenieure wird nicht mehr bestehen.\n\n- Debatte über die Qualität des Outsourcings: Es gibt auch Gegenargumente, dass Outsourcing seit Jahrzehnten besteht und hochwertige Softwareentwicklung nach wie vor lokale Spitzenkräfte erfordert, da Probleme wie Kommunikationskosten, Zeitunterschiede und kulturelle Hintergründe schwer zu lösen sind. Aber Befürworter des Outsourcings argumentieren, dass diese Hindernisse allmählich überwunden werden, da sich die Tools für die Fernzusammenarbeit weiterentwickeln und die Managementmethoden verbessert werden.\n\n> (von aurareturn): "Ich habe seit 2022 auf HN gesagt: Alle nordamerikanischen Entwickler, die vollständige Fernarbeit unterstützen, werden überrascht sein, wenn ihr Unternehmen beschließt, euch durch Mitarbeiter im Ausland zu ersetzen. Wenn alle remote arbeiten, warum sollte das Unternehmen dann fünfmal so viel für euch ausgeben, anstatt einen engagierteren und weniger beschwerdeführenden Mitarbeiter im Ausland einzustellen?... Die Unterstützung der Rückkehr ins Büro könnte langfristig eure Karriere retten."\n\n3. Die Rolle der KI: Produktionswerkzeug, Entlassungsgrund oder Kapital "Vampir"?\n\nDie Diskussion über die Rolle der künstlichen Intelligenz (KI) in dieser Welle von Entlassungen zeigt komplexe Meinungsverschiedenheiten.\n\n- Direkte Ersatzwirkung begrenzt: Die meisten Menschen sind sich einig, dass die derzeitige KI nicht in der Lage ist, erfahrene Software-Ingenieure vollständig zu ersetzen. Aber sie hat bereits begonnen, einige Junior- und repetitive Aufgaben zu ersetzen, wie einige kleinere Beratungsaufgaben. Einige Berater berichten, dass Kunden sie nicht mehr kontaktieren, weil sie kleine Bugs mit ChatGPT lösen können.\n\n- "Perfekte Ausrede" für Entlassungen: Eine weit verbreitete Meinung ist, dass KI zur "perfekten Ausrede" für Unternehmen geworden ist, um Entlassungen und Kostensenkungen durchzuführen. Selbst wenn der eigentliche Grund für die Entlassungen ein wirtschaftlicher Rückgang oder Entscheidungen des Managements sind, sind Unternehmen bereit, dies als strategische Anpassung zu verpacken, um "KI zu umarmen und die Effizienz zu steigern".\n\n- "Schwarzes Loch" des Kapitals: KI spielt eine weitere Schlüsselrolle – sie saugt das verbleibende Risikokapital ab, das in andere Technologiebereiche fließen könnte. VCs interessieren sich jetzt fast ausschließlich für KI-Projekte, was die Finanzierung von Startups in nicht-KI-Bereichen erschwert.\n\n4. Die "Rostgürtel"-Transformation der Technologiebranche? Strukturelle Sorgen um die Zukunft\n\nEinige Diskutanten äußern aus einer makroökonomischen Perspektive Besorgnis über die Zukunft und ziehen Parallelen zwischen der Technologiebranche und dem einst blühenden, dann verfallenden Fertigungssektor im "Rostgürtel".\n\n- Wiederholung des Arbeitsplatzverlusts: So wie die USA einst die Fertigung nach China auslagerten, wandern jetzt IT- und Softwareentwicklungsjobs massenhaft nach Indien, Lateinamerika und Osteuropa. Dies könnte dazu führen, dass die einst hochbezahlte Gruppe von Software-Ingenieuren mit langfristiger struktureller Arbeitslosigkeit konfrontiert wird.\n\n- Politische und soziale Auswirkungen: Wenn eine große Anzahl von Arbeitsplätzen im mittleren Einkommensbereich in der Technologiebranche verschwindet, könnte dies neue soziale und politische Probleme auslösen, ähnlich wie der Verfall des "Rostgürtels" bis heute die politische Landschaft der USA beeinflusst.\n\n- Kontroversen um Einwanderungs- und Visapolitik (H1B/O1): Ein Teil der Diskussion richtet sich gegen Arbeitsvisa wie H1B, die als missbraucht angesehen werden, um die Gehälter lokaler Ingenieure zu drücken und den Wettbewerb zu verschärfen. Andere verteidigen vehement die technische Einwanderung und argumentieren, dass gerade diese Spitzenkräfte aus der ganzen Welt (wie Absolventen der Universität Waterloo) das Fundament für Innovation in Silicon Valley bilden.\n\n5. Unternehmensführung und kulturelle Veränderungen: Der "Musk-Effekt"\n\nEin interessanter Punkt ist, dass Musks massive Entlassungen bei Twitter (jetzt X) einen Demonstrationseffekt erzeugt haben.\n\n- Rationalisierung von Entlassungen: Als Musk mehr als 75 % der Twitter-Mitarbeiter entließ und das Produkt weiterhin funktionierte, begannen viele CEOs zu reflektieren: "Wenn er das kann, warum kann ich das nicht?" Dies brach das frühere Denken in Technologieunternehmen auf, dass "je mehr Talente, desto besser" ist, und machte große Entlassungen psychologisch und geschäftlich leichter akzeptierbar.\n\n6. Politische und politische Faktoren: Kontroversen über Steuerrechtsänderungen\n\nEin technischer, aber weitreichender Hinweis betrifft die Änderungen im US-Steuerrecht.\n\n- Regelung zur Abschreibung von F&E-Ausgaben (Section 174): Im Steuerreformgesetz (TCJA) der Trump-Regierung von 2017 gibt es eine Bestimmung, die Unternehmen ab 2022 vorschreibt, die Gehälter für Softwareentwicklung und andere F&E-Ausgaben über fünf Jahre abzuschreiben, anstatt wie zuvor im Jahr der Ausgaben vollständig abzuziehen. Dies erhöht die Steuerlast für Technologieunternehmen (insbesondere Startups) erheblich und hemmt die Bereitschaft zur Rekrutierung in den USA.\n\n- Korrekturwirkung kürzlich verabschiedeter Gesetze: Das kürzlich verabschiedete "Build Back Better, BBB"-Gesetz hat dieses Problem teilweise behoben, indem es wieder erlaubt, dass inländische F&E-Ausgaben sofort abgezogen werden können. Einige Kommentatoren glauben, dass sie um Juli herum eine Erholung des Rekrutierungsmarktes gespürt haben, was damit zusammenhängen könnte.\n\nAbschließend\n\nAus diesen Diskussionen wird deutlich, dass die Gründe für die derzeitige Schwäche der Beschäftigung in der Technologiebranche in Kalifornien recht komplex sind und nicht auf einen einzelnen Faktor zurückzuführen sind. Es kann nicht einfach auf "KI ersetzt den Menschen" oder "zyklische Rückgänge in der Branche" reduziert werden, sondern ist das Ergebnis eines Zusammenspiels verschiedener Faktoren, darunter die wirtschaftliche Bereinigung nach dem Ende der Nullzinsära, die Umstrukturierung des globalen Arbeitsmarktes durch das Homeoffice, die doppelte Auswirkung von KI als neue Technologie und Kapitalmagnet sowie spezifische Änderungen in der Steuerpolitik.\n\nIch weiß nicht, wann wir aus dieser Krise herauskommen werden? Oder ob die Gründe nicht nur die oben diskutierten sind.

46,38K

Transkription: Warum große Sprachmodelle keine Software wirklich erstellen können

Autor: Conrad Irwin

Eine Sache, mit der ich viel Zeit verbracht habe, ist die Befragung von Software-Ingenieuren. Das ist offensichtlich eine anspruchsvolle Aufgabe, und ich kann nicht sagen, dass ich ein Geheimrezept habe; aber diese Erfahrung hat mir tatsächlich Zeit gegeben, darüber nachzudenken, was ein effizienter Software-Ingenieur wirklich tut.

Der Kernzyklus der Softwareentwicklung

Wenn man einen echten Experten beobachtet, stellt man fest, dass sie ständig die folgenden Schritte in einem Zyklus ausführen:

* Ein mentales Modell über die Anforderungen aufbauen.

* Code schreiben (hoffentlich?!), der die Anforderungen erfüllt.

* Ein mentales Modell über das tatsächliche Verhalten des Codes aufbauen.

* Die Unterschiede zwischen beiden herausfinden und dann den Code (oder die Anforderungen) aktualisieren.

Es gibt viele Möglichkeiten, diese Schritte zu erledigen, aber das Besondere an effizienten Ingenieuren ist, dass sie in der Lage sind, klare mentale Modelle zu erstellen und aufrechtzuerhalten.

Wie schneiden große Sprachmodelle ab?

Um fair zu sein, große Sprachmodelle sind ziemlich gut im Schreiben von Code. Wenn man auf ein Problem hinweist, sind sie auch gut darin, den Code zu aktualisieren. Sie können alles tun, was echte Ingenieure tun: Code lesen, Tests schreiben und ausführen, Protokolle hinzufügen und (vermutlich) einen Debugger verwenden.

Aber was sie nicht können, ist, ein klares mentales Modell aufrechtzuerhalten.

Große Sprachmodelle geraten in endlose Verwirrung: Sie nehmen an, dass der Code, den sie geschrieben haben, tatsächlich funktioniert; wenn Tests fehlschlagen, können sie nur raten, ob sie den Code oder den Test reparieren sollen; wenn sie frustriert sind, löschen sie einfach alles und fangen von vorne an.

Das steht im krassen Gegensatz zu den Eigenschaften, die ich von Ingenieuren erwarte.

Software-Ingenieure testen während der Arbeit. Wenn ein Test fehlschlägt, können sie ihr mentales Modell heranziehen, um zu entscheiden, ob sie den Code oder den Test reparieren oder vor der Entscheidung mehr Informationen sammeln sollten. Wenn sie frustriert sind, können sie Hilfe suchen, indem sie mit anderen kommunizieren. Obwohl sie manchmal auch alles löschen und von vorne anfangen, geschieht dies erst, nachdem sie ein klareres Verständnis des Problems erlangt haben.

Aber das wird bald erledigt sein, oder?

Wird sich das ändern, wenn die Modelle leistungsfähiger werden? Vielleicht?? Aber ich denke, das erfordert eine grundlegende Veränderung in der Art und Weise, wie Modelle aufgebaut und optimiert werden. Das Modell, das für die Softwareentwicklung benötigt wird, ist nicht nur eines, das Code generieren kann.

Wenn eine Person auf ein Problem stößt, kann sie vorübergehend den gesamten Kontext beiseitelegen, sich auf die Lösung des aktuellen Problems konzentrieren und dann ihre Gedanken wieder aufnehmen, um zum übergeordneten Problem zurückzukehren. Sie können auch zwischen dem großen Ganzen und den mikroskopischen Details hin und her wechseln, vorübergehend Details ignorieren, um sich auf das Gesamtbild zu konzentrieren, und bei Bedarf in die Tiefe gehen. Wir werden nicht effizienter, nur weil wir mehr Wörter in unser "Kontextfenster" stopfen; das macht uns nur verrückt.

Selbst wenn wir mit riesigen Kontexten umgehen können, wissen wir, dass diese generativen Modelle derzeit mehrere ernsthafte Probleme haben, die ihre Fähigkeit, ein klares mentales Modell aufrechtzuerhalten, direkt beeinträchtigen:

* Kontextverlust: Modelle sind nicht gut darin, ignorierte Kontextinformationen zu erkennen.

* Neuheitsbias: Sie sind stark von Neuheitsbias betroffen, wenn sie mit Kontextfenstern umgehen.

* Halluzinationen: Sie neigen dazu, "Details" zu "halluzinieren", die nicht existieren sollten.

Diese Probleme sind vielleicht nicht unüberwindbar, und Forscher arbeiten daran, den Modellen Gedächtnis zu verleihen, damit sie ähnliche Denktechniken wie wir anwenden können. Aber leider können sie derzeit (nach einer bestimmten Komplexität) tatsächlich nicht verstehen, was passiert.

Sie können keine Software erstellen, weil sie nicht in der Lage sind, gleichzeitig zwei ähnliche "mentale Modelle" aufrechtzuerhalten, die Unterschiede zu erkennen und zu entscheiden, ob sie den Code oder die Anforderungen aktualisieren sollen.

Was ist also jetzt zu tun?

Offensichtlich sind große Sprachmodelle für Software-Ingenieure nützlich. Sie können schnell Code generieren und zeigen hervorragende Leistungen bei der Integration von Anforderungen und Dokumentation. Für bestimmte Aufgaben ist das bereits ausreichend: Die Anforderungen sind klar genug, das Problem ist einfach genug, und sie können es in einem Rutsch erledigen.

Das gesagt, für jede Aufgabe mit ein wenig Komplexität können sie nicht präzise genug den erforderlichen Kontext aufrechterhalten, um durch Iteration letztendlich eine praktikable Lösung zu produzieren. Du, als Software-Ingenieur, musst weiterhin dafür sorgen, dass die Anforderungen klar sind und dass der Code tatsächlich die Funktionen erfüllt, die er verspricht.

Bei Zed glauben wir, dass die Zukunft darin besteht, dass Menschen und KI-Agenten gemeinsam Software entwickeln können. Aber wir sind fest davon überzeugt (zumindest im Moment), dass du der Fahrer am Steuer bist und große Sprachmodelle nur ein weiteres Werkzeug sind, das dir zur Verfügung steht.

62,8K

宝玉 erneut gepostet

Gestern habe ich auf der Produktmanager-Konferenz von CSDN gesprochen.

Vor drei Monaten, als mich die Freunde von CSDN eingeladen haben, auf der Produktmanager-Konferenz zu sprechen, wollte ich eigentlich ablehnen.

Der Grund war, dass mein Startup erst seit einem halben Jahr besteht und ich nicht viel wertvolle Einsichten habe, die ich mit allen teilen könnte.

Aber die Freunde von CSDN sagten, das sei in Ordnung, die Konferenz ist in drei Monaten, es gibt genug Zeit, und ich könnte auch einige meiner früheren Produkterfahrungen teilen.

Zufälligerweise, nachdem wir letzte Woche FlowSpeech veröffentlicht haben, hat sich der Ruf des Produkts enorm verbessert, MRR ist um das Dreifache gestiegen, und ARR hat auch ein kleines Ziel überschritten. Noch wichtiger ist, dass unsere Nutzer durch die Nutzung des Produkts echtes Geld verdient haben, was der beste Beweis für die Stärke unseres Produkts ist.

Deshalb habe ich gestern während meines Vortrags zu allen gesagt, dass der Wert dieser PPT heute sprunghaft angestiegen ist, und ich bitte alle, gut zuzuhören.

37,37K

"Als Landwirt kaufe ich nur biologische Lebensmittel; als AI-Experte schaue ich mir nur Inhalte an, die nicht von AI generiert wurden"😅

马东锡 NLP 🇸🇪15. Aug., 16:12

Ich weiß nicht, wie es euch geht, aber als AI-Entwickler wehre ich mich instinktiv gegen alles, was von AI generiert wurde.

Wenn ich Code überprüfe und denke, dass er von AI geschrieben wurde, schreibe ich direkt LGTM.

Wenn ich Artikel lese und merke, dass sie von AI generiert wurden, schalte ich sofort ab.

Wenn das UI einer Website offensichtlich von AI erstellt wurde, schalte ich sofort ab.

Wenn ein Podcast von AI generiert ist, schalte ich sofort ab.

Wenn ein Kurzvideo von AI erstellt wurde, streiche ich es sofort und wechsle zu Videos von Gebrauchtwagenhändlern oder Reparaturen von Eselhufen.

Ich finde, es ist unverantwortlich gegenüber meinem Körper und Geist, mich von AI-generierten Inhalten in Bezug auf mein Dopamin und Endorphine täuschen zu lassen.

AI-generierte Inhalte haben natürlich ihren Wert, aber nur als Zwischenprodukt, das letztendlich von Menschen eingegeben und ausgegeben wird; sie sollten nicht und können nicht langfristig als endgültige Form zirkulieren.

62K

Vibe Coding ist ein irreführender Begriff, der sehr negativ behaftet ist. Seine größte Bedeutung liegt darin, dass es mithilfe von KI Prototypenentwicklung ermöglicht, die dabei hilft, die Produktanforderungen schnell zu klären. In der Softwaretechnik sind die Codes für die Prototypenentwicklung in der Regel wegwerfbar; bei der eigentlichen Produktentwicklung müssen das Systemdesign und die Codierung neu erstellt werden. Das Ergebnis von Vibe Coding ist ähnlich: Nachdem die Anforderungen festgelegt sind, muss das Design erneut überarbeitet und die Entwicklung wiederholt werden.

铁锤人14. Aug., 21:07

Schätzungsweise wissen viele Leute nicht, was Vibe-Coding ist?

Dieser Begriff wurde von dem KI-Guru Andre Karpathy geprägt,

wenn du der KI ein Problem beschreibst und sie dann selbst den Code schreibt.

Es gilt nur für einfache Wochenendprojekte, die nur du selbst nutzen würdest.

Da es sich um ein unwichtiges Projekt handelt, kann sie nach Gefühl handeln, ohne wirklich planen oder testen zu müssen.

👇 Hier beginnt der Traum.

48,06K

Im Kontextengineering muss der Agent Werkzeuge und Umgebungen nutzen, um Daten zu sammeln und den Kontext zu vervollständigen.

dontbesilent14. Aug., 05:13

Ich habe plötzlich verstanden, was es mit Claude Code und Comet auf sich hat, und warum der Agent sowohl in der CLI als auch im Browser erscheint und zur Mainstream-Wahl geworden ist.

Der Ort, an dem der Agent erscheint, ist sehr wichtig!

Entwickler verwenden gerne Claude Code, weil sie ihren Code über die CLI steuern können. Der Code ist tatsächlich der Kontext, um mit dem großen Modell zu kommunizieren. Mit dem Code kann ich weniger reden, und die Arbeit des Agents ändert direkt die Dateien auf meinem Computer.

Aber heute habe ich ein bisschen herumexperimentiert und festgestellt, dass Leute, die sich mit Medien beschäftigen, das nicht nutzen können, weil sie auf ihrem Computer überhaupt nichts haben. Der Kerninhalt befindet sich in Apps und im Browser.

Aber Claude Code ist schwer zu nutzen, um Informationen aus dem Browser und den Apps zu erhalten, sodass das Kernproblem nicht darin besteht, ob ich Sonnet oder Opus verwende, sondern dass dieser Agent nicht in der Kommandozeile erscheinen sollte.

Dieser Agent sollte im Browser erscheinen! Zum Beispiel der Coze-Workflow, den Douyin ständig anpreist, um Daten von Xiaohongshu zu erfassen, könnte einfach mit Comet erledigt werden.

Für Leute, die sich mit Medien beschäftigen, ist Comet der wahre Claude Code, denn der Agent der Medienmacher muss im Browser erscheinen.

Im Vergleich zu früheren Dia-Browsern wirkt das sehr dumm, denn das ist kein Agent, sondern ein LLM.

Wenn man nur ein LLM im Browser einfügt, halte ich das für nahezu bedeutungslos.

15,08K

Selbststudium in Informatik TeachYourselfCS

Wenn du ein selbstgelerntes Ingenieur bist oder einen Programmierkurs abgeschlossen hast, ist es sehr wichtig, Informatik zu lernen. Glücklicherweise musst du dafür nicht jahrelang Zeit und viel Geld für ein Studium aufwenden: Mit deinem eigenen Einsatz kannst du eine Ausbildung auf Weltklasse-Niveau erhalten💸.

Im Internet gibt es viele Lernressourcen, aber es gibt sowohl gute als auch schlechte. Was du brauchst, ist keine Liste wie „200+ kostenlose Online-Kurse“, sondern die Antworten auf folgende Fragen:

Welche Fächer solltest du lernen und warum?

Was sind die besten Bücher oder Videokurse zu diesen Fächern?

In diesem Leitfaden versuchen wir, auf diese Fragen klare Antworten zu geben.

Deedy14. Aug., 09:59

"Lehre dir selbst Informatik" ist die beste Ressource, um Informatik zu lernen.

Nach 2 Wochen im Vibe-Coding fühlen sich nicht-technische Personen unwohl. "Ich wünschte, ich wäre technisch versiert. Ich weiß einfach nicht, wie ich weitermachen soll."

Es dauert etwa 1000 Stunden über 9 Themen, um Informatik in irgendeiner Tiefe zu verstehen.

152,06K

宝玉 erneut gepostet

Freunde, kommt her~ Ich habe 3 Millionen Nutzer und nur 20 Euro verdient: Die falsche Blüte der KI-Tools - ListenHub

Witze erzählen, wer kann das nicht? Viele Leute waren zuvor an dem Fall interessiert, den ich auf Hardland Hackers geteilt habe, und haben speziell mit @oran_ge's Listenhub einen Witz-Podcast erstellt. Hört mal rein~

29,23K

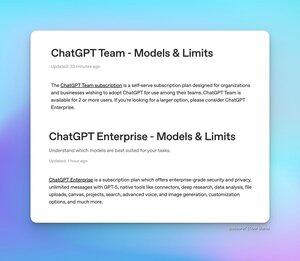

Viele Freunde interessieren sich für die Nutzungseinschränkungen der Teamversion (Team) und der Unternehmensversion (Enterprise) von ChatGPT. Jetzt hat das offizielle Team zwei neue FAQ-Artikel veröffentlicht, die dies erklären.

* ChatGPT Teamversion - Die Nutzung von GPT-5 und GPT-4o ist unbegrenzt, aber es gibt folgende Einschränkungen für die verschiedenen Modellversionen:

* 200 Anfragen pro Tag für GPT-5 Thinking

* 2800 Anfragen pro Woche für GPT-5 Thinking mini

* 15 Anfragen pro Monat für GPT-5 Pro

* 500 Anfragen alle 3 Stunden für GPT-4.1

* 300 Anfragen pro Tag für o4-mini und o3

* ChatGPT Unternehmensversion - Die Nutzung von GPT-5, GPT-4o und GPT-4.1-mini ist unbegrenzt, aber es gibt folgende Einschränkungen für die verschiedenen Modellversionen:

* 200 Anfragen pro Woche für GPT-5 Thinking

* 15 Anfragen pro Monat für GPT-5 Pro

* 20 Anfragen pro Woche für GPT-4.5

* 500 Anfragen alle 3 Stunden für GPT-4.1

* 300 Anfragen pro Tag für o4-mini

* 100 Anfragen pro Tag für o4-mini-high

* 100 Anfragen pro Woche für o3

* 15 Anfragen pro Monat für o3-pro

In dem FAQ-Artikel wird auch erwähnt, dass die Einschränkungen für das GPT-5 Thinking-Modell vorübergehend sind und tatsächlich höher sind als die oben aufgeführten langfristigen Einschränkungen.

Tibor Blaho14. Aug., 03:17

Für alle, die nach den Limits von ChatGPT Team & Enterprise fragen - es gibt 2 neue FAQ-Artikel

- ChatGPT Team - unbegrenzte GPT-5 und GPT-4o, 200 GPT-5 Thinking-Anfragen/Tag, 2800 GPT-5 Thinking-Mini-Anfragen/Woche, 15 GPT-5 Pro-Anfragen/Monat, 500 GPT-4.1-Anfragen/3 Stunden, 300 o4-mini und o3-Anfragen/Tag

- ChatGPT Enterprise - unbegrenzte GPT-5, GPT-4o und GPT-4.1-mini, 200 GPT-5 Thinking-Anfragen/Woche, 15 GPT-5 Pro-Anfragen/Monat, 20 GPT-4.5-Anfragen/Woche, 500 GPT-4.1-Anfragen/3 Stunden, 300 o4-mini-Anfragen/Tag, 100 o4-mini-high-Anfragen/Tag, 100 o3-Anfragen/Woche, 15 o3-pro-Anfragen/Monat

Der FAQ-Artikel erwähnt, dass die Limits für GPT-5 Thinking vorübergehend höher sind als die oben angegebenen langfristigen Raten.

15,52K

Das ist wahr: Man sollte in den Prompts weniger sagen, was man nicht tun soll, sondern was man tun sollte. Große Modelle sind in dieser Hinsicht den Menschen ähnlich; je weniger man ihnen erlaubt, etwas zu tun, desto mehr wird ihre Aufmerksamkeit darauf gelenkt.

素人极客-Amateur Geek13. Aug., 23:50

Wenn du möchtest, dass das Modell etwas nicht tut oder verbietet,

versuche, es nicht direkt zu schreiben!!!

versuche, es nicht direkt zu schreiben!!!

versuche, es nicht direkt zu schreiben!!!

Hier sind einige Methoden, die ich einfach erklären möchte:

1. Wenn du es unbedingt schreiben musst, schreibe nicht mehr als zwei Punkte.

2. Verwandle das "nicht wollen" in ein "wollen". Schreibe keine fehlerhaften Sätze – du musst jeden Satz überprüfen, um sicherzustellen, dass die Einleitung, der Übergang und die Verbindung zwischen den Sätzen stimmen.

3. Verbote sollten von einmaligem Verbot zu mehrfachen Verboten übergehen. Manche Dinge kann man sich nicht beim ersten Mal merken. Als ich zur Schule ging, sagte mein japanischer Lehrer, dass es in japanischen Unternehmen eine besondere Eigenschaft gibt, dass sie nicht müde werden, eine einfache Sache zu erklären, um sicherzustellen, dass du es nicht vergisst. Selbst die kleinsten Dinge werden durch häufige Erwähnung im Gedächtnis bleiben. Du kannst am Anfang verbieten, in der Mitte verbieten, an verwandten Stellen verbieten und auch am Ende verbieten.

4. Wenn das Verbot bedeutet, dass etwas nicht getan werden soll, füge einen Schritt hinzu, um eine Aufgabe in zwei Schritte zu unterteilen. Füge am Ende einen Satz hinzu, der besagt, dass du, nachdem du die vorherige Aufgabe abgeschlossen hast, mich fragen sollst, ob es Verbotsartikel gibt. Ich werde dir dann die Verbotsartikel zusenden, und dann beginnen wir mit der Überprüfung der Verbotsartikel. Bei lokalen Änderungen stelle sicher, dass andere Informationen unverändert bleiben.

5. Setze die Verbotsartikel an den Anfang.

6. Stelle sicher, dass deine Verbotsartikel auch wirklich verbieten können. Wenn du dem Text keinen bestimmten Stil gegeben hast und der Text einen AI-Ton hat, nützt es nichts, ihm zu verbieten, im AI-Stil zu sprechen, denn er weiß selbst nicht, in welchem Stil er spricht!

63,85K

Top

Ranking

Favoriten

Onchain-Trends

Im Trend auf X

Aktuelle Top-Finanzierungen

Am bemerkenswertesten