Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

les données d'IA incarnée sont imprévisibles, multimodales et profondément liées à leur environnement. Les pipelines alimentant les LLM ne peuvent pas suivre.

Les cas limites du monde réel ne peuvent pas être extraits. Ils doivent être orchestrés et vérifiés.

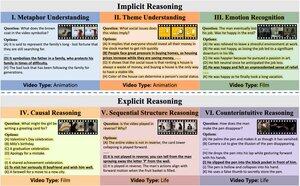

Les travaux récents de Zhu et al. et l'enquête sur les grands modèles de raisonnement multimodal montrent pourquoi :

→ Les LMRM étouffent sur des entrées bruyantes et dynamiques.

→ L'utilisation des outils est fragile.

→ La planification à long terme dans des environnements physiques est encore loin.

1,85K

Meilleurs

Classement

Favoris